本文经机器之心(微信公众号:almosthuman2014)授权转载,禁止二次转载

在近日发表的一篇论文中,图灵奖得主 Yoshua Bengio 等详细介绍了其团队当前的研究重心:将机器学习与因果推理相结合的因果表示学习。研究者不仅全面回顾了因果推理的基础概念,并阐释了其与机器学习的融合以及对机器学习的深远影响。该论文已被《Proceedings of the IEEE》期刊接收。

一直以来机器学习和因果推理是两个相对独立的研究方向,各有优缺点。但在过去数年,两者开始互相借鉴,推进彼此的发展。如机器学习领域的蓬勃发展促进了因果推理领域的发展。采用决策树、集成方法、深层神经网络等强大的机器学习方法,可以更准确地估计潜在结果。在机器之心 2018 年的报道文章中,图灵奖得主、因果关系模型倡导者之一 Judea Pearl 也探讨了当前机器学习理论的局限性以及来自因果推理的七个启发。于是,近年来,将两者结合起来的因果表示学习(Causal Representation Learning)吸引了越来越多的关注,成为人类迈向 Human Level AI 的潜在方向。今天,我们再为大家推荐一篇因果表示学习论文:Yoshua Bengio 团队发表的《Towards Causal Representation Learning》,该论文已被《Proceedings of the IEEE》期刊接收。在 2020 年底的一场讲座中,Bengio 称这是他们当前研究项目的核心。

论文链接:https://arxiv.org/pdf/2102.11107.pdfYoshua Bengio 等人在这篇论文中回顾了因果推理的基础概念,并将其与机器学习的关键开放性问题联系起来,如迁移与泛化,进而分析因果推理可能对机器学习研究做出的贡献。反过来看也是如此:大多数因果研究的前提是因果变量。因此目前 AI 与因果领域的核心问题是因果表示学习,即基于低级观测值发现高级因果变量。最后,该论文描绘了因果对机器学习的影响,并提出了该交叉领域的核心研究方向。

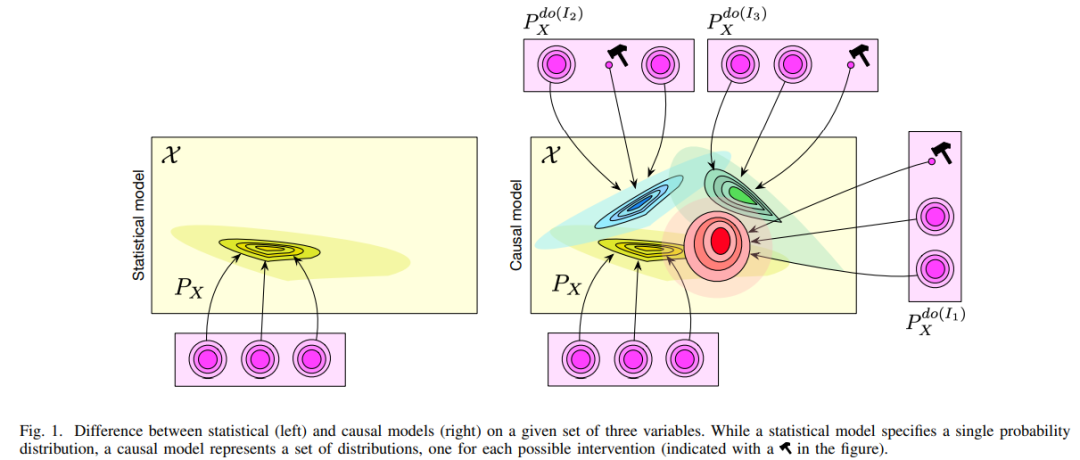

论文第二章介绍了物理系统中因果建模的不同层级,第三章展示了因果模型与统计模型的区别。这里不仅探讨了建模能力,还讨论了所涉及的假设与挑战。

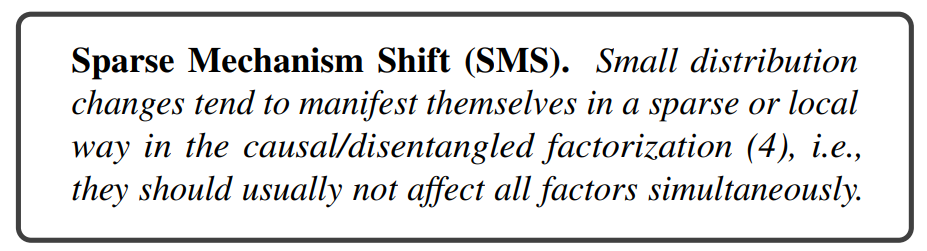

论文第四章将独立因果机制(Independent Causal Mechanisms,ICM)原则扩展为基于数据估计因果关系的核心组件,即将稀疏机制转移(Sparse Mechanism Shift)假设作为 ICM 原则的结果,并探讨它对学习因果模型的影响。

论文第五章回顾了现有基于恰当描述子(或特征)学习因果关系的方法,覆盖经典方法和基于深度神经网络的现代方法,主要聚焦促成因果发现的底层原则。

论文第六章探讨了如何基于因果表示数据学习有用的模型,以及从因果角度看机器学习问题。

论文第七章分析了因果对实际机器学习的影响。研究者使用因果语言重新诠释了鲁棒性和泛化,以及半监督学习、自监督学习、数据增强和预训练等常见技术。研究者还探讨了因果与机器学习在科学应用中的交叉领域,并思考如何结合二者的优势,创建更通用的人工智能。

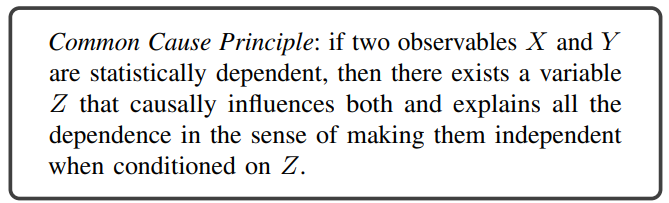

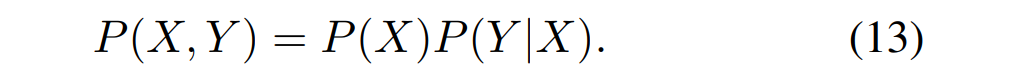

统计模型是对现实的粗浅描述,因为它们只需建模关联。对于给定的输入样本 X 和目标标签 Y,我们可能会想近似 P(Y |X) 以回答如下问题:「该图像包含狗的概率是多少?」或者「在给定诊断测量指标(如血压)下,病人心脏衰竭的概率是多少?」。在合适的假设下,这些问题可以通过基于 P(X, Y) 观察足量的独立同分布(i.i.d.)数据来得到答案。干预式问题(Interventional question)的挑战性要比预测更高,因为它们所涉及的行为超出了统计学习独立同分布设置。干预(intervention)可能影响因果变量子集的值及其关系。例如「增加一个国家中鹳鸟的数量能否促进人类生育率的增长?」、「如果烟草被更多地添加了社会污名化色彩,抽烟的人是否会减少?」反事实问题需要对事情的发生原因进行推理,在事情发生后设想不同行为的后果,决定哪些行为可以达到期望的结果。回答反事实问题要比回答干预式问题更难。但是,这对于 AI 而言或许是关键挑战,因为智能体能从想象行为的后果和了解哪些行为带来特定结果中获益。数据格式在推断关系类型中发挥重大作用。我们可以辨别数据模态的两轴:观测数据 vs 干预数据,手动工程数据 vs 原始(非结构化)感知输入。观测与干预数据:人们常常假设但很少严格得到的一种极端数据格式是观测独立同分布数据,其每个数据点均独立采样自相同的分布。手动工程数据与原始数据:在经典 AI 中,数据常被假设成可结构化为高级和语义有意义的变量,这可能部分对应于底层图的因果变量。这部分主要介绍统计建模与因果建模的区别,并用形式化语言介绍了干预与分布变化。对于独立同分布数据,强大的泛一致性(universal consistency)可以确保学习算法收敛至最低风险。这类算法确实存在,例如最近邻分类器、支持向量机和神经网络。但是,目前的机器学习方法通常在面对不符合独立同分布假设的问题时性能较差,而这类问题对人类而言轻而易举。Reichenbach [198] 清晰地描述了因果与统计相关性之间的联系:

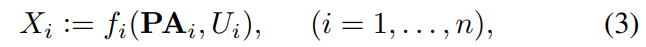

X 与 Y 一致的情况属于特例。在没有额外假设的情况下,我们无法利用观测数据区分这些情况。此时,因果模型要比统计模型包含更多信息。如果只有两个观测值,则因果结构发现会很难,但当观测值数量增多后,事情反而容易多了。原因在于,这种情况下存在多个由因果结构传达的非平凡条件独立性。它们将 Reichenbach 原则泛化,并且可以用因果图或结构因果模型的语言进行描述,将概率图模型与干预概念融合在一起。SCM 考虑与有向无环图(directed acyclic graph, DAG)的顶点相关的一组观测值(或变量)X_1, . . . , X_n。该研究假设每个观测值根据以下公式得出:

从数学角度讲,观测值也是随机值。直观来看,我们可以把独立噪声理解为在图上扩散的「信息探头」(就像在社交网络上扩散的流言的独立元素)。这当然并不只是两个观测值,因为任何非平凡条件独立语句都要求至少三个变量。统计模型可以通过图模型来定义,即带图的概率分布。如果图的边是因果性的,则该图模型为因果模型(这时,该图即为「因果图」)。结构因果模型由一组因果变量和一组结构方程构成,这些方程基于噪声变量 U_i 分布。

独立性概念包含两个方面:一个与影响有关,一个与信息相关。在因果研究历史中,不变、自主和独立的机制以多种面目出现。例如,Haavelmo [99] 的早期工作假设改变 structural assignment 的其中一个,会使其他保持不变;Hoover [111] 介绍了不变准则:真正的因果序是在恰当干预下的不变性;Aldrich [4] 探讨了这些思想在经济学中的历史发展;Pearl [183] 详细探讨了自主性(autonomy),认为当其他机制服从外部影响时,因果机制能够保持不变。该研究将任意现实世界分布视为因果机制的产物。此类分布的变化通常是由至少一个因果机制的变化导致。根据 ICM 原则,研究者得出了以下假设:

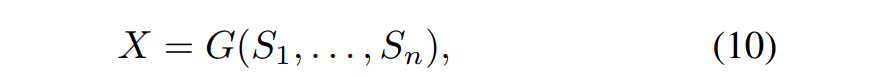

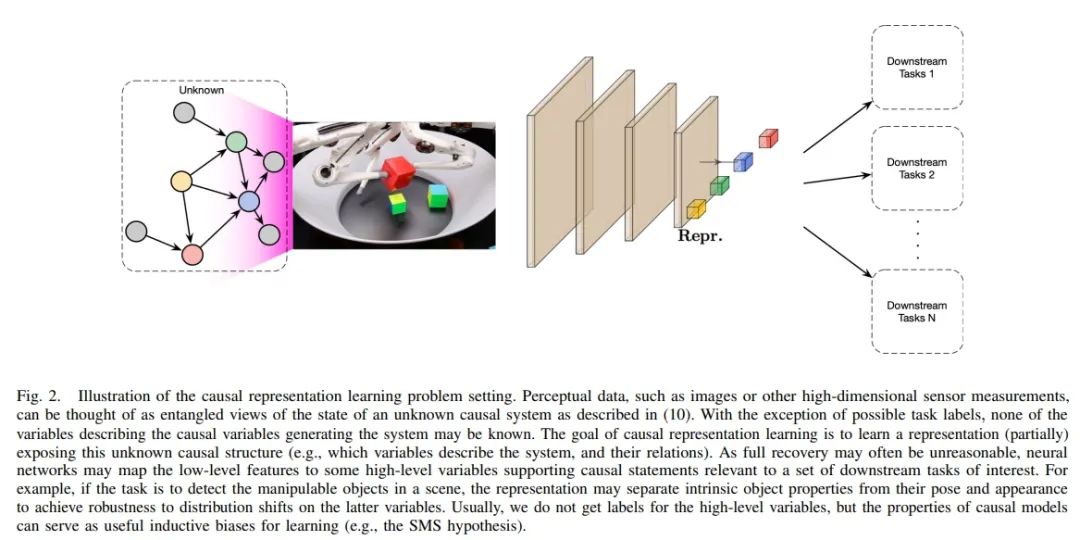

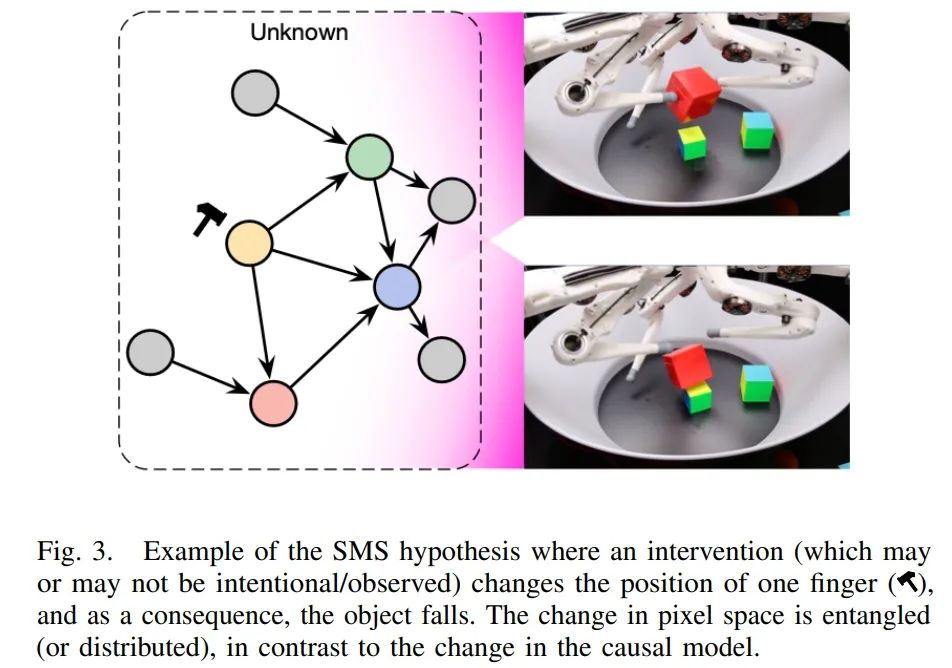

在 ICM 原则中,研究者表述了两个机制(形式化为条件分布)的独立性意味着这两个条件分布不应互相影响。后者可被理解为要求独立干预。根据 SMS 假设,很多因果结构被认为需要保持不变。所以,分布偏移(如在不同「环境或语境」中观察一个系统)能够为确定因果结构提供很大的帮助。这些语境可以来自干预、不稳定时间序列或者多视图。同样地,这些语境可以被解读为不同的任务,从而与元学习产生关联。传统的因果发现和推理假设单元(unit)是由因果图连接的随机变量。但是,真实世界的观测结果最初往往并未结构化为这些单元,例如图像中的物体。因此,因果表示学习的出现试图从数据中学习到这些变量,正如超越了符号 AI 的机器学习不要求算法操作的符号预先给定一样。基于此,研究者试图将随机变量 S_1, …, S_n 与观测值连接起来,公式如下:

其中 G 是非线性函数。下图 2 展示了一个示例,其中高维观测是对因果系统状态进行查看的结果,然后利用神经网络对其进行处理,以提取在多种任务上有用的高级变量。

为了结合结构因果建模和表示学习,我们应努力将 SCM 嵌入到更大的机器学习模型中,这些模型的输入和输出也许呈现高维和非结构特点,但其内部工作至少部分由 SCM 控制(可使用神经网络对其进行参数化)。研究者在下图 3 中展示了一个可视化示例,其中恰当因果变量的变化很稀疏(移动手指导致手指和方块位置发生变化),但在像素空间等其他表示中变化则很稠密(手指和方块的移动导致很多像素值发生变化)。

研究者从因果表示学习的角度讨论了现代机器学习面临的三个问题,分别是解耦表示学习、可迁移机制学习以及干预式世界模型和推理学习。

上文所有讨论都需要一种不依赖常见 i.i.d. 假设的学习范式。研究者希望做出一种较弱的假设:应用模型的数据可能来自不同的分布,但涉及的因果机制(大多)相同。假设潜在因果图为 X → Y,并且同时想要学习映射 X → Y,则这种情况的因果因式分解如下:

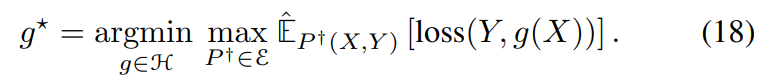

从 SSL 的角度来看,后续发展包括进一步的理论分析和条件式 SSL。将 SSL 视为利用边际 P(X) 和非因果条件式 P(Y |X) 之间的依赖性,这一观点与验证 SSL 合理性的常见假设一致。此外,SSL 领域的一些理论结果使用因果图中众所周知的假设(即使这些假设没有提及因果关系):协同训练理论陈述了无标注数据的可学习性,并且依赖预测器基于给定标签有条件独立的假设。我们通常期望该预测器(仅)由给定标签引起,即反因果设置。现在假设我们处在因果设置中,其中因果生成模型可因式分解为独立的组件,组件之一(本质上)是分类函数。因此,我们或许会期望,如果预测器近似具备固有可迁移性和鲁棒性的因果机制,则对抗样本应该更难找到。最近的工作支持了这种观点:对抗攻击的一种潜在防御方法通过建模因果生成方向来解决反因果分类问题,这种方法在视觉领域中被称为合成式分析(analysis by synthesis)。为了学习一个鲁棒的预测器,我们应该拥有一个环境分布的子集 ,并求解

,并求解

在实践中,求解公式 (18) 需要指定一个具有干预相关集合的因果模型。如果观测环境集合 ε 与可能的环境集合 Ρ_ɡ不一致,则我们将得到额外的估计误差,在最坏的情况下,该估计误差可能会任意大。学习用于解决 (18) min-max 优化问题的预测模型难度较高。该研究将机器学习中的多个常见技术解释为近似 (18) 的方法。第一个方法是丰富训练集的分布;第二个方法通常与前一个结合使用,即依赖数据增强来增加数据多样性;第三个方法是依靠自监督学习 P(X)。一个有趣的研究方向是将所有这些技术结合起来,即基于来自多个模拟环境的数据进行大规模训练、数据增强、自监督和鲁棒性微调。相比机器学习主流研究,强化学习 (RL) 更接近因果研究,因为它有时能够高效地直接估计 do-probabilities。但是,在离策略学习设置下,尤其是批(或观测)设置下,因果问题变得细微。应用于强化学习的因果学习可以分为两个方面:因果归纳和因果推理。强化学习设置下的因果归纳与经典因果学习设置下所面临的挑战大有不同,因为因果变量通常是给定的。但是,越来越多的证据表明恰当环境结构化表示的有效性。例如:世界模型;

泛化、鲁棒性与快速迁移;

反事实;

离线强化学习

当机器学习应用于自然科学领域时,一个基本的问题是:我们可以在多大程度上用机器学习来补充对物理系统的理解。一个有意思的方向是使用神经网络进行物理仿真,它与手工设计的模拟器相比效率要高得多。另一方面,缺乏系统的实验条件可能会在医疗等应用领域遭遇挑战。

因果关系在帮助理解医学现象方面具有巨大的潜力。在新冠疫情期间,因果中介分析(causal mediation analysis)有助于,在观察到辛普森悖论的教科书式示例时,真正查出不同因素对病死率的影响。科学应用的另一个示例是天文学,研究者们使用因果模型在仪器混淆的情况下识别系外行星。多任务学习是指构建一个可以在不同环境中解决多个任务的系统。这些任务通常具有一些共同的特征。通过学习跨任务的相似性,系统在遇到新任务时可以更有效地利用从先前任务中获得的知识。在这一方面,我们显然已经走了很长一段路,且没有明确地将多任务问题视为因果问题。在海量数据和算力的推动下,人工智能在广泛的应用领域里取得了显著的进步。这也让人们产生了一个问题:「为什么我们不能直接训练一个巨大的模型来学习环境动态(如强化学习中的设定),使其包含所有可能的干预呢?」毕竟,分布式表示可以泛化至未见样本,如果基于大量干预进行训练,则我们可能会得到一个在大量干预之间实现良好泛化的大型神经网络。要这么做的话,首先如果数据的多样性不够,则最糟糕的情况是未见分布偏移造成的误差仍然可能很高。此外,如果我们拥有一个能够成功应对特定环境中所有干预的模型,则我们可能希望在具备相似动态的不同环境中使用它,尽管不一定动态完全相同。本质上,i.i.d. 模式识别只是一种数学抽象,因果关系对于大多数形式的 animate learning 而言可能是必不可少的。然而直到现在,机器学习仍忽略对因果关系的完整集成,该研究认为机器学习会从集成因果概念中获得收益。研究者认为,将当前的深度学习方法与因果关系的工具和思想结合起来,可能是迈向通用 AI 系统的必经之路。