针对机器学习模型的后门攻击越来越受学术界、工业界等的关注。它可以通过在输入数据上添加一个特定的小trigger,导致机器学习模型将这些输入都分类错误成一个目标类。近年来,已有较多工作展示了后门攻击在各个机器学习领域中的可行性。

为了更好的理解后门攻击,提高机器学习模型的鲁棒性,BANDS组委会组织举办第一届针对机器学习中的后门攻击和防御的ICLR Workshop研讨会。会议的初衷是为了集结来自学术界、工业界等各个领域的研究者们,来共同探讨和分析机器学习中的后门攻击和防御问题。

本次研讨会将着重讨论并回答以下问题:

我们能在CV/NLP/FL机器学习模型中发现哪些其他类型的后门攻击?

我们能否在其他领域发起后门攻击,如二进制分析工具、网络入侵检测系统、强化学习等?

各种任务中的后门攻击有什么异同?

我们如何衡量不同领域中的后门攻击的隐蔽性?在现实世界中发动后门攻击的成本和实用性如何?

现有防御技术在所研究领域的性能如何?它们能否适用于其他领域?

我们如何开发一种通用的防御方法,以应对各种后门攻击,甚至是未见过的攻击?

是否有其他形式的防御措施在现实世界中是实用的?

「时间和地点」

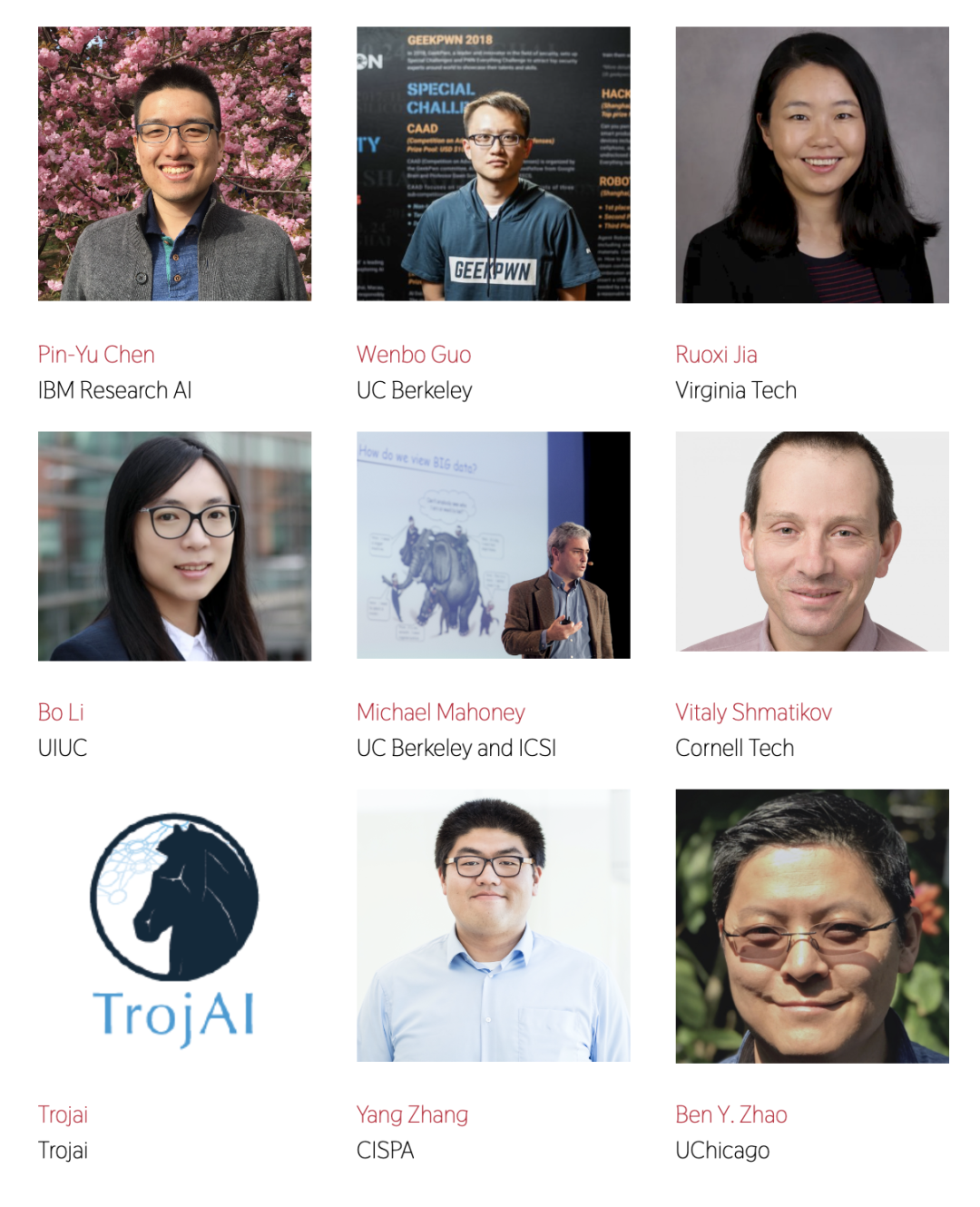

「特邀嘉宾」

本次研讨会邀请到了来自UC Berkeley、UIUC、Cornell、UChicago、CISPA、IBM、Virginia Tech等九位大佬前来为大家分享他们在相关领域的最新研究!

https://iclr23-bands.github.io/