Linear Regression with Multiple Variables

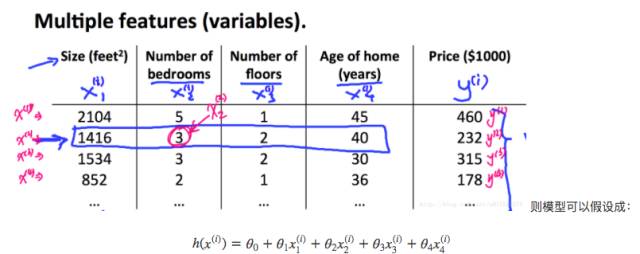

紧接上一篇的例子 – 房价预测。现在我们有更多的特征来预测房价了,“房间的数量”、“楼层”、“房龄”……

说明一下接下来要用到的符号:

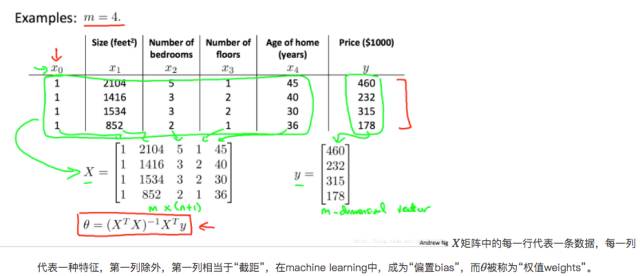

训练集(部分)如下图所示:

训练集(部分)如下图所示:

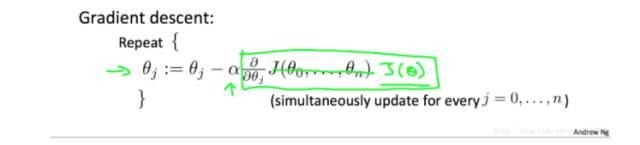

然后再用上一篇中说的gradient descent方法更新

θ即可,过程如下:

Gradient descent in practice

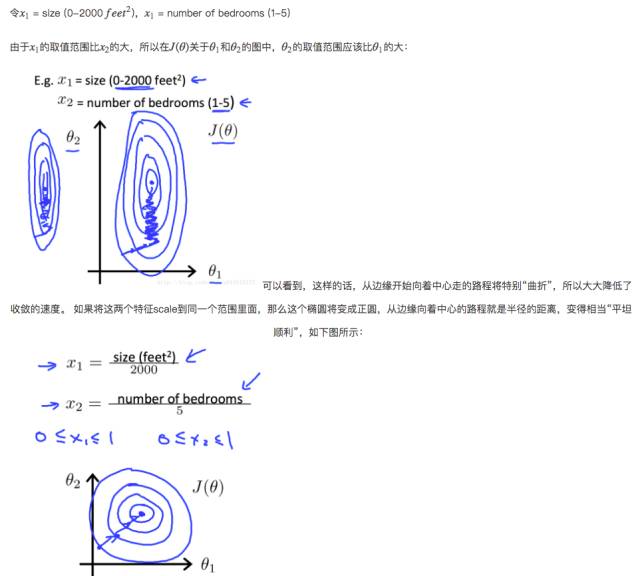

让特征们的取值处于同一个范围里面,可以加快梯度下降法的收敛速度。原因在下图中形象说明了。

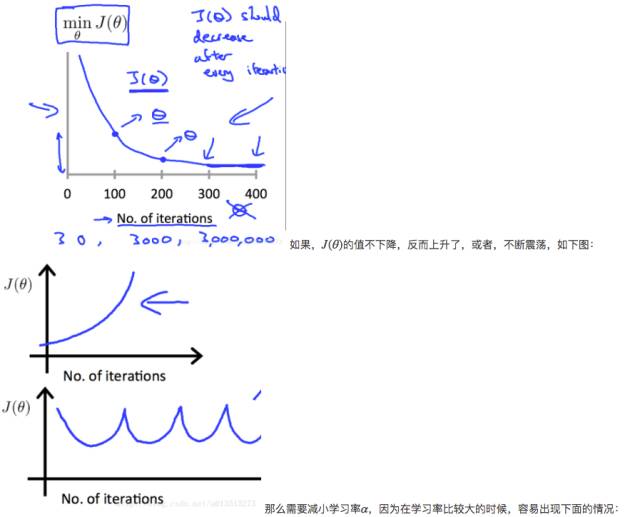

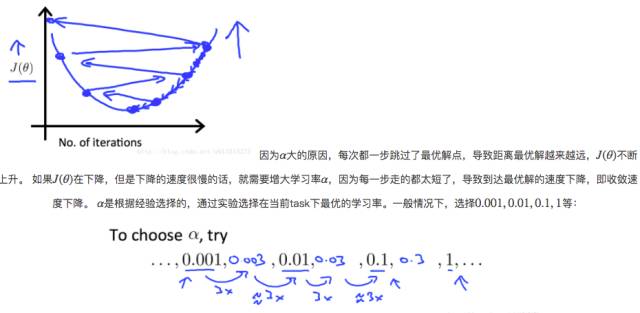

2.2 Choose Learning Rate α

在不断更新θ即迭代次数不断增加之后,J(θ)的值应该不断下降,直至不怎么改变了,模型训练完毕,如下图中最后平坦的部分:

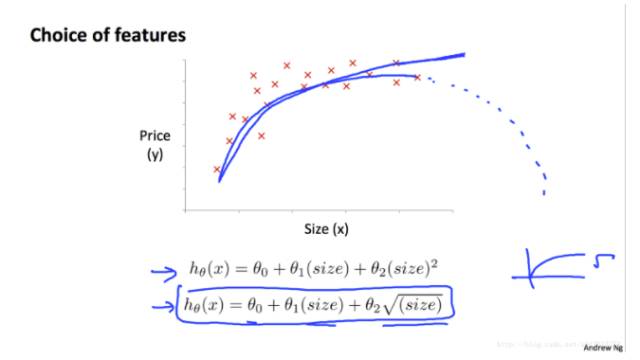

Features and Polynomial Regression

除了训练集中已经给出的特征,还可以根据这些特征来生成新的特征。比如说最简单的,已有特征“长”和“宽”,可以使用生成的特征“面积”来进行模型的学习。

另外h(x)也可以使用polynomial regression来代替linear regression,则:

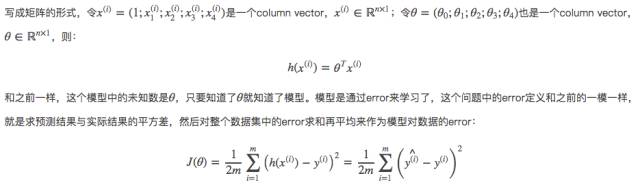

在实际计算过程中,用矩阵来计算会提升计算速度。下面就来看看怎么转换成矩阵形式。

如下例子:

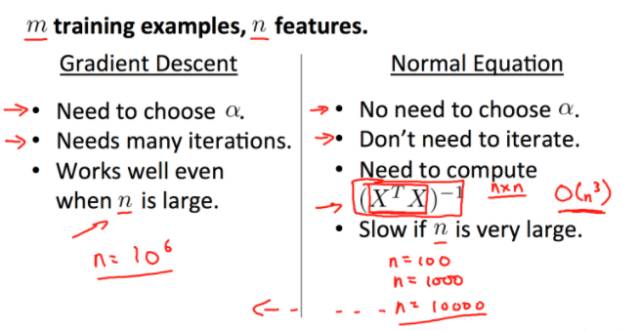

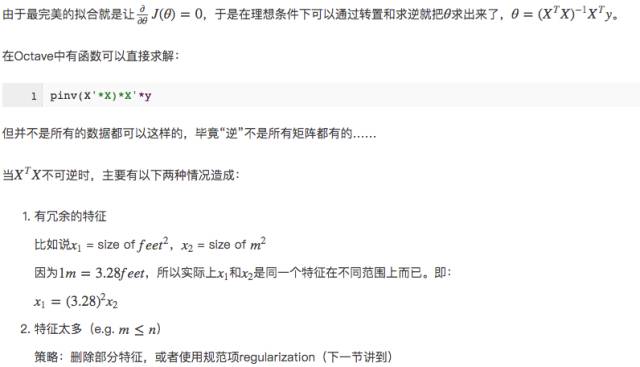

在Linear Regression中,Normal equation可以用来取代Gradient descent来计算

θ。

下面是Gradient descent和Normal Equation的比较: