但也有批评者表示,这根本就不是用户真实的腿部运动,Meta只是利用技术模拟了运动轨迹,让行动看起来真实一些。

不过相比其他元宇宙应用中的「意念飞行」或者「假腿滑行」来说,Meta确实实现了元宇宙中零条腿的突破。

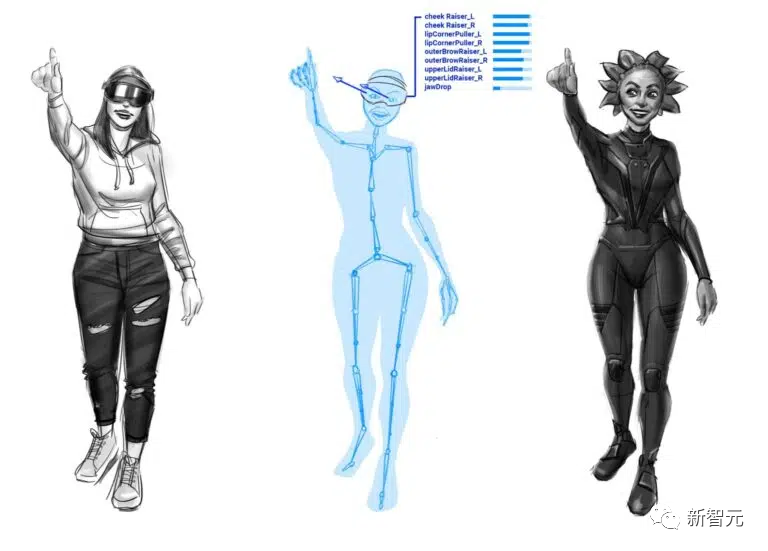

而Oculus软件开发包(SDK)最近也发布了更新,开发者可以在新设备使用身体追踪、面部追踪、眼球追踪技术,可以将用户在现实中的一举一动都带入到映射到元宇宙中。

所以,Meta到底是怎么让虚拟化身长腿的?

首先提一个问题,「长腿」这件事,对「你自己」来说更重要,还是对别人更重要?

比如在FPS游戏里,我们从来没有看到过使用角色的腿长什么样(除了死亡视角),所以如何让用户观察到「其他角色」的正常腿部运动才是解决问题的关键。

Meta首席技术官Andrew Bosworth在一次Instagram会议上回答关于「腿部追踪」问题时,明确表示:

我们目前的战略就是研究如何让旁观者看起来「你」的腿更自然,因为实际上上他们也不知道你的腿到底是如何摆放的。如果你低下头看自己的腿时,可能仍然什么也看不到,不过这也不重要。

而Meta让虚拟化身站起来的秘密就藏在9月20日上传到arXiv的一篇论文里。

论文链接:https://arxiv.org/pdf/2209.09391.pdf

先看一下他们的解决方案演示视频,仅通过头显即可实现对人体运动的实时跟踪,可以极大提升AR/VR中的沉浸式互动体验。

从独立的可穿戴设备如HMD(头戴式设备)或AR眼镜中获得的关于身体的传感器数据非常有限。

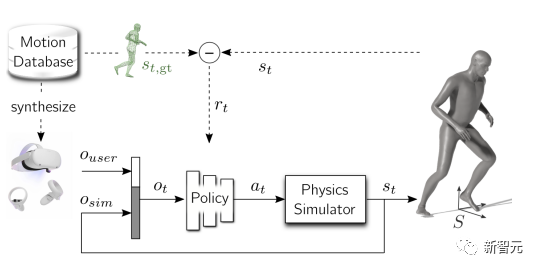

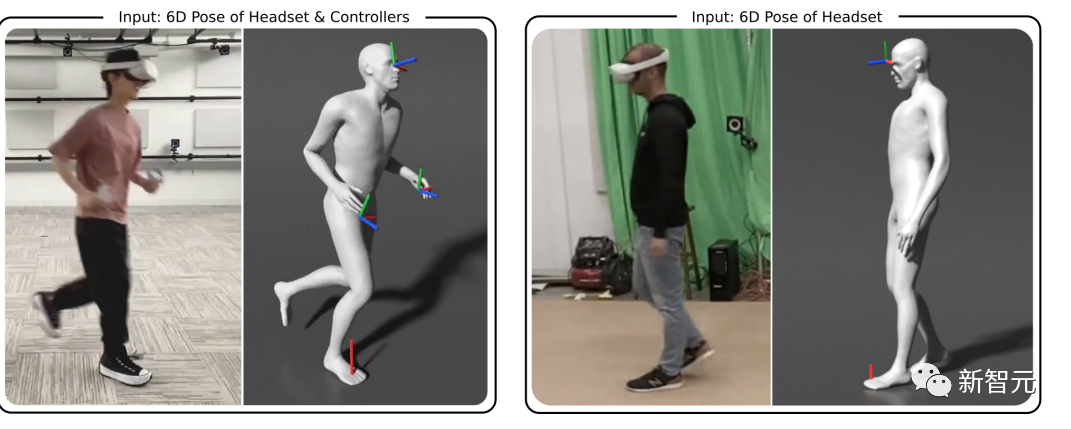

这篇论文中,Meta提出了一个强化学习框架,接收来自HMD和两个控制器的稀疏信号,并模拟可信的、物理上有效的全身运动。

在训练中使用高质量的全身运动数据作为监督,然后用一个简单的策略网络可以学习输出适当的扭力,以使角色实现平衡、行走和跳跃,同时密切跟踪输入信号。

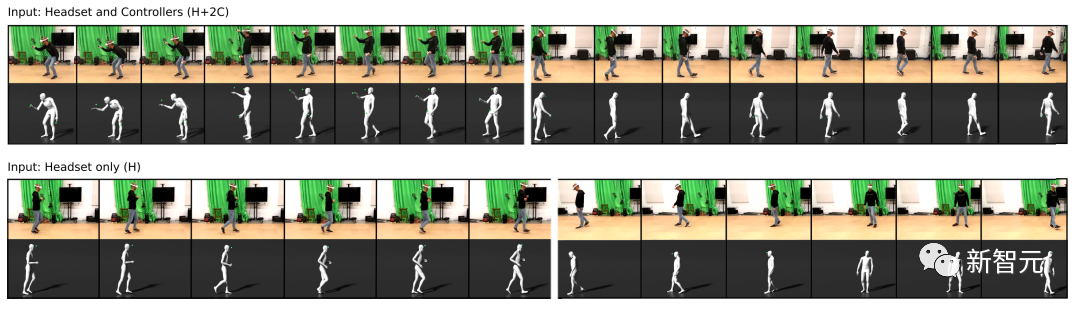

实验结果表明,在完全没有观察到下半身的情况下,即使输入的只是HMD的6D变换,模型预测的腿部运动与真实运动轨迹相似度非常高。

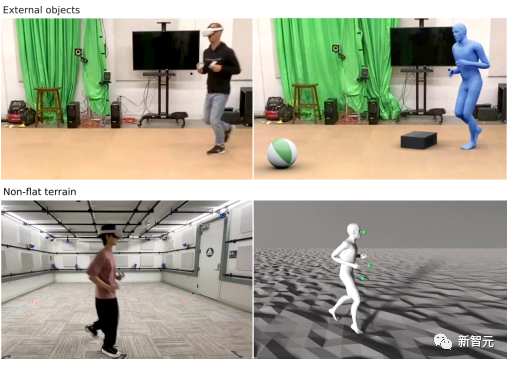

研究人员还证明,单一的策略网络可以对不同的运动方式、不同的身体尺寸和新环境也具有鲁棒性。

虽然官方宣传这项功能是「身体追踪」(body tracking),但实际上更准确的形容是「身体姿势估计」。

发言人形容这项技术是逆运动学(inverse kinematics,IK)和机器学习(ML)的结合。

IK指的是一类基于已知位置估计骨骼(或机器人)部件未知位置的方程,其中的方程式是为应用程序中的全身虚拟现实化身提供运动的基础。

开发者不需要实现(甚至不需要理解) IK 背后的数学原理,像 Unity和Unreal这样的游戏引擎已经内置了IK

其他的一些身体跟踪技术往往需要一些专用硬件,比如像HTC 的Vive Tracker等,而VR 的 IK 往往是不准确的,Meta的主要卖点在于它的机器学习模型可以免费生成更精确的身体姿势。

在一次面向开发者的演讲中,身体追踪产品经理Vibhor Saxena表示,未来几年身体跟踪的新改进将通过相同的 API 提供,所以无需更换设备即可享受最新的身体跟踪技术。

但这种方法仍然存在一些关键问题没有解决,比如如何流畅地处理坐姿和站姿之间的变换,以及如何使腿部在用拇指移动时看起来自然。

通过这项技术安装的腿行动轨迹也并非完全准确,并且有160ms的延迟,在72Hz的设置下,大约是11帧。

不过相比当下的元宇宙应用程序中,虚拟化身的移动看起来更像是在滑行或「意念飞行」来说,这项技术已经是重大进步了。

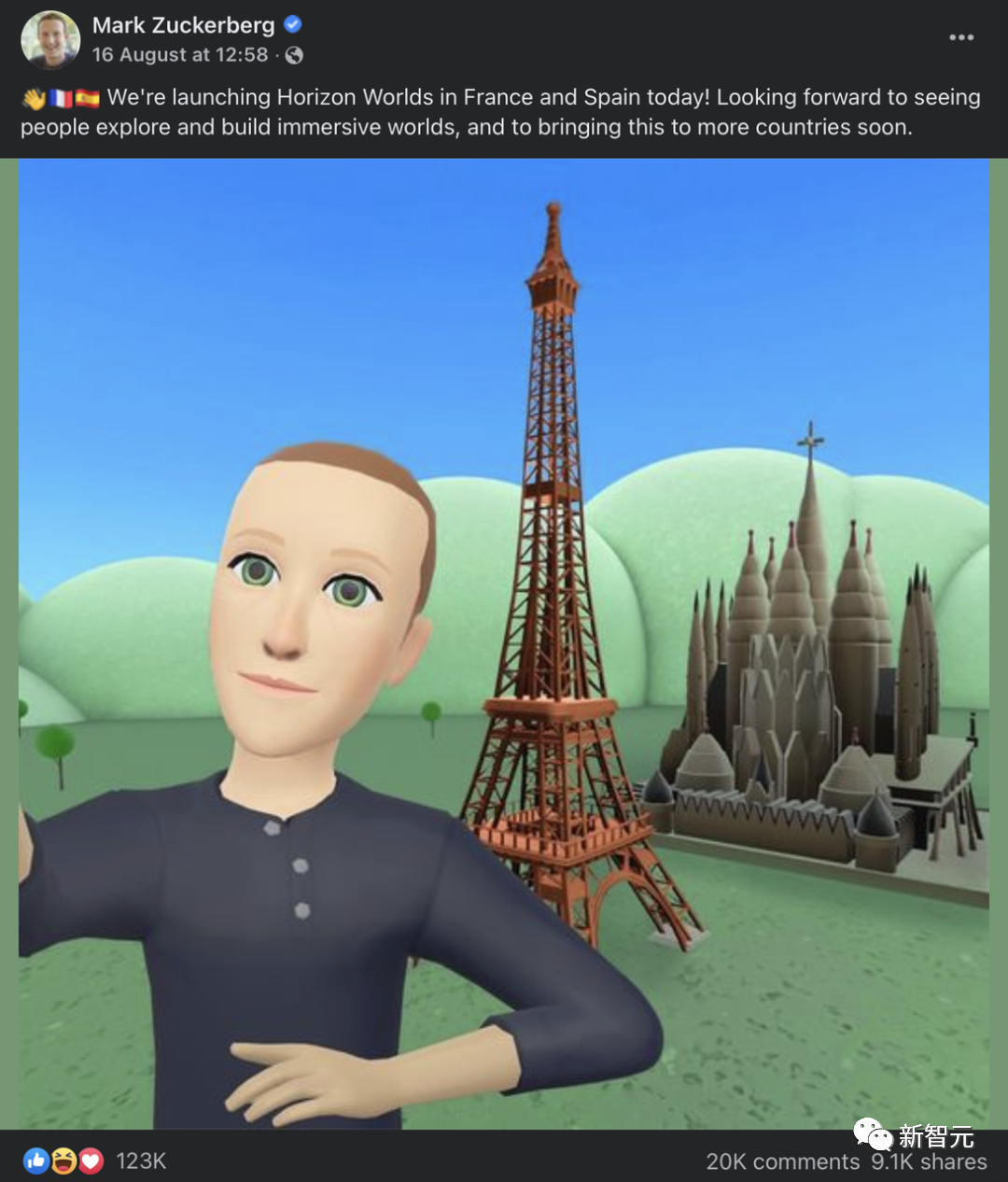

Meta说是「身体追踪」,但实际上只是「身体模拟」,引来了大量批评的声音,不过也有大量的网友表示支持,网友Christian Schildwaechter提供了相当专业的评论。

认定Meta还没有提供身体追踪的完整解决方案有些不公平,因为其他厂商也没有做到这一点。

他们的宣传片并不代表他们软件的当前状态,更多的是他们的目标。Meta公司经常把演示弄得一团糟,不管是用非常令人毛骨悚然的化身,还是夸大没有人真正关心的东西,但他们仍然在做领域内相当尖端的东西。

当然,其他公司实现全身追踪技术已经有很长一段时间了,但这需要在硬件和高速计算机上进行巨大投资。

现有的软件IK已经存在很长一段时间了,但它经常会破坏沉浸感、生成一些物理上不可能的姿势,或者在移动时导致肘部受到影响。

必须看看他们的方法效果如何,以及他们是否能够为腿部想出一个可用的解决方案,但考虑到他们只依靠手和头的位置,并在一个计算能力非常弱的设备上运行,同时还必须并行渲染世界,其结果看起来相当令人印象深刻。

更重要的是,该研究方向极有可能是正确的。

当下移动端硬件的发展过于缓慢,无法在不完全破坏电池寿命的情况下迅速提高分辨率、FoV和图形界面。

为了实现优雅的无障碍VR,需要做得更聪明,而不仅仅是用更快的芯片,无论是通过ETFR减少负载、智能升频还是利用人类视觉的极限。

机器学习将是其中的一个重要部分,因为它可以将大部分计算需求转移到最初的模型构建阶段,而这种方法可以在像Quest 2这样的低功率设备上正常工作。

Meta也已经展示了对定制的低功耗神经引擎芯片的研究,以集成到未来的SoC中,这可能是他们与高通合作的一个重要部分,所以未来的Quest版本将更好地满足这一需求。

即使是专业的FBT系统也经常产生一些古怪的错误,但经过训练的人工智能解决方案不仅有助于从很少的传感器输入中快速得出骨骼信息,而且训练本身排除了很多纯粹基于传感器的跟踪解决方案可能建议的物理上不可能的结果。

Meta令人印象深刻的是,他们一直在推动消费类设备的可行解决方案,而这些设备在很长一段时间内将不得不利用非常有限的资源。

因此,与其批评他们仍然没有工作的腿,或者批评他们在宣传片中的动作捕捉方案,我们应该偶尔承认他们提供了其他商业供应商没有展示过的解决方案,并继续向公众发布软件产品,否则这些方案只能在研究实验室中找到。

我们仍然处于VR和追踪技术的初级阶段,要想让它对大量主流观众来说足够有用且无故障,还需要好几年的时间,但Meta公司实际上正在将它推向那里。