随机森林的 10 折交叉验证

再回到之前的随机森林(希望还没忘记,机器学习算法-随机森林初探(1))

library(randomForest)

set.seed(304)

rf1000 rf1000

##

## Call:

## randomForest(x = expr_mat, y = metadata[[group]], ntree = 1000)

## Type of random forest: classification

## Number of trees: 1000

## No. of variables tried at each split: 84

##

## OOB estimate of error rate: 11.69%

## Confusion matrix:

## DLBCL FL class.error

## DLBCL 57 1 0.01724138

## FL 8 11 0.42105263

除了

OOB,我们还可以怎么评估模型的准确性呢?这里没有测试集,那么就拿原始数据做个评估吧(注意:这样会低估预测错误率):

# 查看模型的类,为randomForest

class(rf1000)

## [1] "randomForest"

# 查看 predict 函数的帮助,默认帮助信息为通用函数 predict 的

# ?predict

# 查看 randomForest 类的 predict 的帮助(predict+'.'+类名字)

# 像 print 此类函数,也是如此查看帮助或源码

# type 参数: response 表示返回分类的值;prob 表示分类的概率;vote 表示 vote counts

# ?predict.randomForest

开始预测

preds

查看下preds对象,显示的是每个样品被预测为属于什么类。

preds

## DLBCL_1 DLBCL_2 DLBCL_3 DLBCL_4 DLBCL_5 DLBCL_6 DLBCL_7 DLBCL_8 DLBCL_9 DLBCL_10 DLBCL_11

## DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL

## DLBCL_12 DLBCL_13 DLBCL_14 DLBCL_15 DLBCL_16 DLBCL_17 DLBCL_18 DLBCL_19 DLBCL_20 DLBCL_21 DLBCL_22

## DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL

## DLBCL_23 DLBCL_24 DLBCL_25 DLBCL_26 DLBCL_27 DLBCL_28 DLBCL_29 DLBCL_30 DLBCL_31 DLBCL_32 DLBCL_33

## DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL

## DLBCL_34 DLBCL_35 DLBCL_36 DLBCL_37 DLBCL_38 DLBCL_39 DLBCL_40 DLBCL_41 DLBCL_42 DLBCL_43 DLBCL_44

## DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL

## DLBCL_45 DLBCL_46 DLBCL_47 DLBCL_48 DLBCL_49 DLBCL_50 DLBCL_51 DLBCL_52 DLBCL_53 DLBCL_54 DLBCL_55

## DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL DLBCL

## DLBCL_56 DLBCL_57 DLBCL_58 FL_1 FL_2 FL_3 FL_4 FL_5 FL_6 FL_7 FL_8

## DLBCL DLBCL DLBCL FL FL FL FL FL FL FL FL

## FL_9 FL_10 FL_11 FL_12 FL_13 FL_14 FL_15 FL_16 FL_17 FL_18 FL_19

## FL FL FL FL FL FL FL FL FL FL FL

## Levels: DLBCL FL

计算模型效果评估矩阵(也称混淆矩阵),敏感性、特异性

100%。完美的模型!!!(这里主要是看下predict如何使用,完美的模型只是说构建的完美,不能表示预测性能的完美,因为没有用独立数据集进行评估。)

library(caret)

## Warning: package 'caret' was built under R version 4.0.3

## Loading required package: lattice

## Loading required package: ggplot2

##

## Attaching package: 'ggplot2'

## The following object is masked from 'package:randomForest':

##

## margin

caret::confusionMatrix(preds, metadata[[group]])

## Confusion Matrix and Statistics

##

## Reference

## Prediction DLBCL FL

## DLBCL 58 0

## FL 0 19

##

## Accuracy : 1

## 95% CI : (0.9532, 1)

## No Information Rate : 0.7532

## P-Value [Acc > NIR] : 3.343e-10

##

## Kappa : 1

##

## Mcnemar's Test P-Value : NA

##

## Sensitivity : 1.0000

## Specificity : 1.0000

## Pos Pred Value : 1.0000

## Neg Pred Value : 1.0000

## Prevalence : 0.7532

## Detection Rate : 0.7532

## Detection Prevalence : 0.7532

## Balanced Accuracy : 1.0000

##

## 'Positive' Class : DLBCL

##

predict还可以返回分类的概率 (有了这个是不是就可以绘制 ROC

曲线和计算AUC 值了)。

preds_prob head(preds_prob)

## DLBCL FL

## DLBCL_1 0.951 0.049

## DLBCL_2 0.972 0.028

## DLBCL_3 0.975 0.025

## DLBCL_4 0.984 0.016

## DLBCL_5 0.963 0.037

## DLBCL_6 0.989 0.011

predict还可以返回分类的vote值。

preds_prob head(preds_prob)

## DLBCL FL

## DLBCL_1 0.951 0.049

## DLBCL_2 0.972 0.028

## DLBCL_3 0.975 0.025

## DLBCL_4 0.984 0.016

## DLBCL_5 0.963 0.037

## DLBCL_6 0.989 0.011

前面主要是学习下predict和confusionMatrix函数的使用。把前面的代码串起来,就构成了一个随机森林的

10 折交叉验证代码:

# https://stackoverflow.com/questions/47960427/how-to-calculate-the-oob-of-random-forest

K = 10

m = nrow(expr_mat)

set.seed(1)

kfold

randomForestCV set.seed(seed)

model preds return(data.frame(preds, real=ytest))

}

CV_rf train_set = expr_mat[kfold != x,]

train_label = metadata[[group]][kfold!=x]

validate_set = expr_mat[kfold == x,]

validate_label = metadata[[group]][kfold==x]

randomForestCV(x=train_set, y=train_label, xtest=validate_set, ytest=validate_label, ...)

})

kfold_estimate

查看下10 折交叉验证的预测结果

kfold_estimate

## preds real

## DLBCL_3 DLBCL DLBCL

## DLBCL_8 DLBCL DLBCL

## DLBCL_9 DLBCL DLBCL

## DLBCL_35 DLBCL DLBCL

## DLBCL_57 DLBCL DLBCL

## FL_9 DLBCL FL

## FL_10 DLBCL FL

## FL_18 FL FL

## DLBCL_15 DLBCL DLBCL

## DLBCL_16 DLBCL DLBCL

## DLBCL_40 DLBCL DLBCL

## DLBCL_41 DLBCL DLBCL

## DLBCL_42 DLBCL DLBCL

## DLBCL_44 DLBCL DLBCL

## DLBCL_51 DLBCL DLBCL

## DLBCL_53 DLBCL DLBCL

## DLBCL_5 DLBCL DLBCL

## DLBCL_20 DLBCL DLBCL

## DLBCL_25 DLBCL DLBCL

## DLBCL_32 DLBCL DLBCL

## DLBCL_38 DLBCL DLBCL

## FL_2 DLBCL FL

## FL_12 DLBCL FL

## FL_16 FL FL

## DLBCL_4 DLBCL DLBCL

## DLBCL_6 DLBCL DLBCL

## DLBCL_10 DLBCL DLBCL

## DLBCL_14 DLBCL DLBCL

## DLBCL_18 DLBCL DLBCL

## DLBCL_39 DLBCL DLBCL

## FL_1 DLBCL FL

## FL_6 FL FL

## DLBCL_17 DLBCL DLBCL

## DLBCL_19 DLBCL DLBCL

## DLBCL_22 DLBCL DLBCL

## DLBCL_33 DLBCL DLBCL

## DLBCL_36 DLBCL DLBCL

## DLBCL_45 DLBCL DLBCL

## DLBCL_47 DLBCL DLBCL

## FL_11 DLBCL FL

## DLBCL_13 DLBCL DLBCL

## DLBCL_23 DLBCL DLBCL

## DLBCL_37 DLBCL DLBCL

## DLBCL_52 DLBCL DLBCL

## FL_3 FL FL

## FL_5 FL FL

## FL_17 DLBCL FL

## FL_19 FL FL

## DLBCL_11 DLBCL DLBCL

## DLBCL_12 DLBCL DLBCL

## DLBCL_27 DLBCL DLBCL

## DLBCL_28 DLBCL DLBCL

## DLBCL_54 DLBCL DLBCL

## DLBCL_56 DLBCL DLBCL

## DLBCL_58 DLBCL DLBCL

## FL_14 DLBCL FL

## DLBCL_1 DLBCL DLBCL

## DLBCL_26 FL DLBCL

## DLBCL_29 FL DLBCL

## DLBCL_43 DLBCL DLBCL

## DLBCL_50 DLBCL DLBCL

## FL_8 DLBCL FL

## FL_15 FL FL

## DLBCL_2 DLBCL DLBCL

## DLBCL_7 DLBCL DLBCL

## DLBCL_48 DLBCL DLBCL

## DLBCL_55 DLBCL DLBCL

## FL_4 FL FL

## FL_7 FL FL

## FL_13 FL FL

## DLBCL_21 DLBCL DLBCL

## DLBCL_24 DLBCL DLBCL

## DLBCL_30 DLBCL DLBCL

## DLBCL_31 DLBCL DLBCL

## DLBCL_34 DLBCL DLBCL

## DLBCL_46 DLBCL DLBCL

## DLBCL_49 DLBCL DLBCL

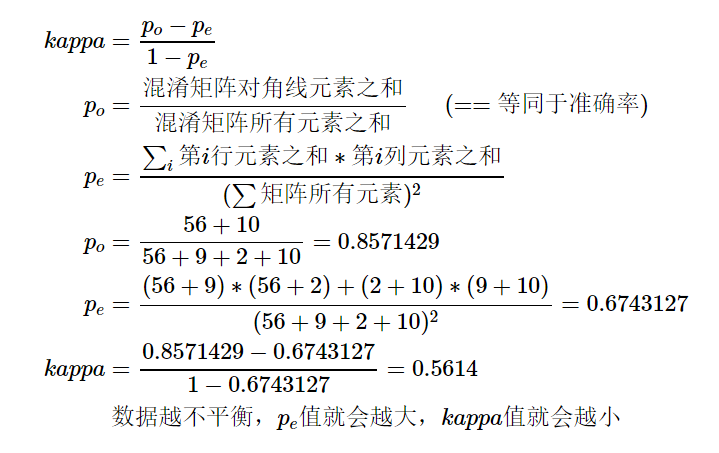

计算模型效果评估矩阵(也称混淆矩阵)。准确性值为0.8581,OOB

的错误率是88.31%,相差不大。但Kappa值不算高0.5614,这也是数据集中两个分组的样本数目不均衡导致的。

library(caret)

caret::confusionMatrix(kfold_estimate$preds, kfold_estimate$real)

## Confusion Matrix and Statistics

##

## Reference

## Prediction DLBCL FL

## DLBCL 56 9

## FL 2 10

##

## Accuracy : 0.8571

## 95% CI : (0.7587, 0.9265)

## No Information Rate : 0.7532

## P-Value [Acc > NIR] : 0.01936

##

## Kappa : 0.5614

##

## Mcnemar's Test P-Value : 0.07044

##

## Sensitivity : 0.9655

## Specificity : 0.5263

## Pos Pred Value : 0.8615

## Neg Pred Value : 0.8333

## Prevalence : 0.7532

## Detection Rate : 0.7273

## Detection Prevalence : 0.8442

## Balanced Accuracy : 0.7459

##

## 'Positive' Class : DLBCL

##

# 结果如下其它指标前面大都有讲述或?confusionMatrix可看到对应的计算公式。

重点看下Kappa系数,其也是评估分类准确性的一个指标。在模型评估指标一文有提到,准确性值在各个分类样本不平衡时会更多偏向样品多的类。而Kappa系数则可以综合评估这种不平衡性。Kappa系数在-1和1之间,值越大表示模型性能越好。

其计算公式如下:

机器学习算法 - 随机森林之决策树初探(1)

机器学习算法-随机森林之决策树R 代码从头暴力实现(2)

机器学习算法-随机森林之决策树R 代码从头暴力实现(3)

机器学习算法-随机森林之理论概述

随机森林拖了这么久,终于到实战了。先分享很多套用于机器学习的多种癌症表达数据集 https://file.biolab.si/biolab/supp/bi-cancer/projections/。

机器学习算法-随机森林初探(1)

机器学习 模型评估指标 - ROC曲线和AUC值

机器学习 - 训练集、验证集、测试集

往期精品(点击图片直达文字对应教程)

后台回复“生信宝典福利第一波”或点击阅读原文获取教程合集

(请备注姓名-学校/企业-职务等)