「 点击上方"GameLook"↑↑↑,订阅微信 」

从最初的游戏、云服务、元宇宙直到最近爆红的AIGC,显卡大户英伟达似乎没有错过科技业界每一波浪潮。正所谓“机会只留给有准备的人”,在一心卖显卡的表象背后,英伟达长期躬耕于计算机领域的基础研究,是一家不折不扣的研发主导型公司。

据2022年年报数据,英伟达集团研发人员16242名,占公司总体超七成,成立至今已投入研发费用累计超290亿美元。英伟达每年在各类计算机学术会议与期刊发表论文超百篇,而在今年的计算图形学顶会SIGGRAPH 2023上,英伟达更是大秀肌肉,一口气发表论文18篇。

此番公布的研究主题涵盖AIGC、虚拟化身、动作捕捉、角色创建以及高写实模拟画面等时兴的图形学研究课题。其中,全新的“海飞丝”技术、AIGC等演示甚至凭借优秀的演示效果在海外社交媒体平台实现了破圈,吸引了不少业内业外人士前来围观。GameLook也对其中部分重点论文进行了摘录,供读者参考。

AIGC文生图:主攻一致性

在万众瞩目的AIGC领域,英伟达此次推出的两篇论文均将图片生成的一致性作为研究焦点。在目前的成熟工作流中,对生成稳定角色有需求的美术师们往往会使用LoRA、Dreambooth等小模型对角色进行预训练,再结合Stable Diffusion生成特定画风的物品或人像。而英伟达针对物品和人像提出了两种不同的训练方式,力图提升个性化空间和加快生成速率。

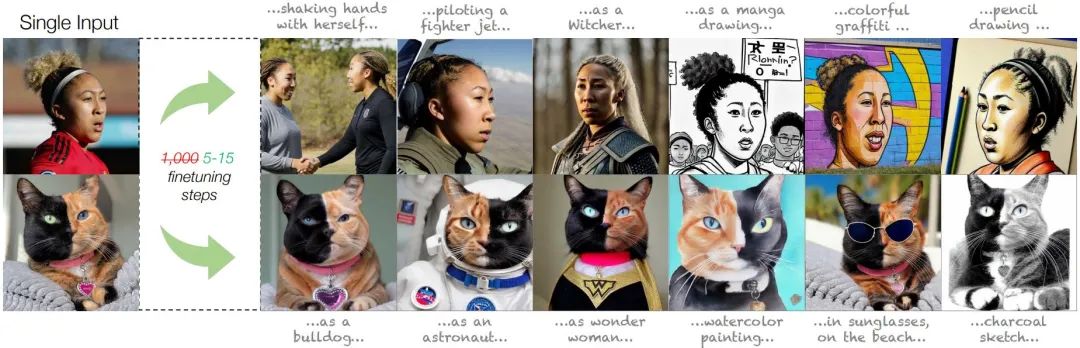

在人像生成方面,英伟达运用了一个编码器(encoder),允许用户输入单张人物图片,并在保留人物个性化特征的情况下,以写实、卡通、大头等多种美术风格生成该角色的不同图片。与此同时,预训练所需的微调步骤也从1000步大幅压缩至5-15步。英伟达称,这将训练所需的时长压缩到了数秒钟。

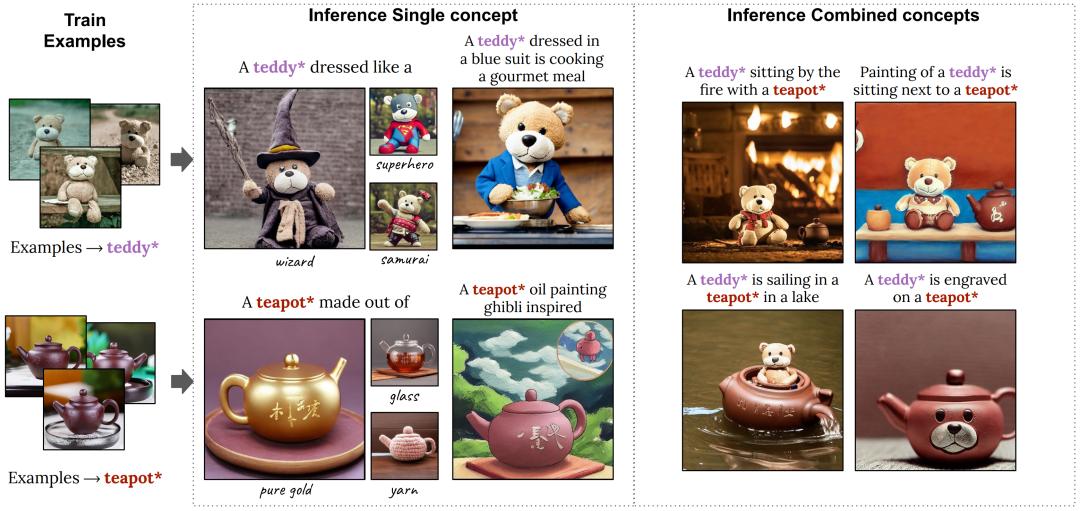

在物品生成方面,英伟达提出了名为“Perfusion”的生成方式,称通过一个仅100kb的模型和4分钟的训练,AI就可掌握一个物品的特征并进行生成。同时,AI还可将学习到的多个物品特征进行结合,并生成于同一张图片内。

相较于已有的LoRA、Dreambooth等成熟训练方法,英伟达的创新脚步并不过分激进。从实验室数据来看,英伟达表示其生成效果与速率都要高于已有训练方法。而实际使用效果如何,还需留待大规模的工业应用检验。

“海飞丝”科技:纤毫毕现的写实毛发模拟

在2018年,网易《逆水寒》项目组曾携AMD研发的TressFX毛发模拟技术登台GDC,向业界分享了领先的实装经验。5年后,同为GPU硬件大牛的英伟达也推出了全新的“海飞丝”科技。

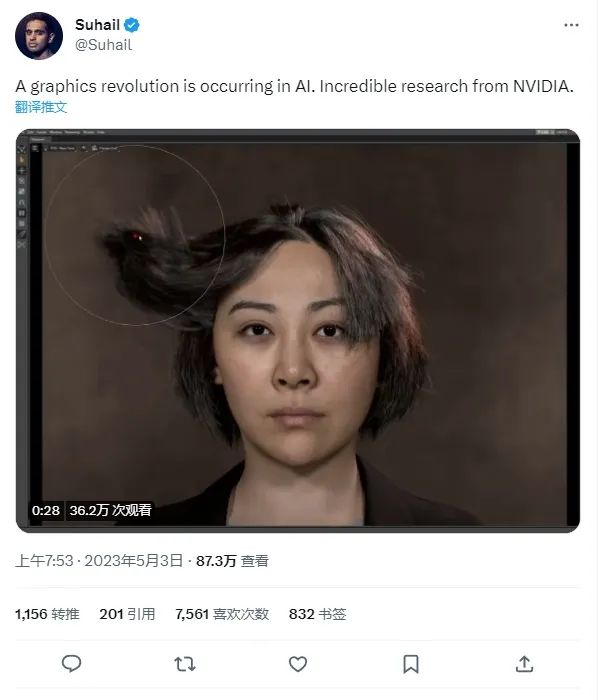

从演示视频上来看,此次的毛发模拟效果真正实现了纤毫毕现,不仅每根毛发都可进行单独的实时物理演算,其还保留了有弹性、光泽等真实毛发的属性,模拟效果出众。

据英伟达介绍,该毛发模拟demo采用了神经科学技术。相较于此前同类模拟算法对CPU的高需求,英伟达将计算单元转移至了GPU,大幅减少了计算压力。同时,该算法可一次对数千至上万根毛发进行实时模拟。

AI创业公司CEO Suhail Doshi将这一演示发布到推特上后,其优越的模拟效果瞬间引来大量吃瓜群众,目前推文已获得7000点赞,阅读量近百万。

虚拟角色:一段视频搞定动捕?

在虚拟角色领域,英伟达没有错过眼下的数字化身热潮,推出了一款2D转3D的人像算法。英伟达称,该算法可以支持用户通过一张图片生成面部的3D表征,并进行实时的动捕。不过,这条赛道早已陷入激烈拼杀,前有Epic的Meta Human面捕+动捕一条龙,后有微软RODIN等文生化身(text-to-avatar)产品围追堵截。相较之下,英伟达的产品特性并不算尤为出彩。

而另一个虚拟角色项目则让GameLook眼前一亮。在不借助动作捕捉技术的前提下,英伟达打造了一套物理模拟系统,让计算机对多名网球运动员的比赛录像进行学习,并通过算法的多重优化,在虚拟世界中重建出了“真实”的网球运动员。

究竟有多真实?从演示视频来看,虚拟运动员的动作精细度已然可以比肩职业网球运动员。虚拟球员在视频学习中学会了发球、上下旋、正反手、单双手击球等多项网球击球动作。假若指定方向,虚拟球员可通过动作微调,将球击向指定的落点。在简单的学习后,两名球员还可进行对战比赛。

难以想象,仅仅凭借学习视频就可取得如此惊人的动作还原效果。如今的3D动作捕捉技术已然十分成熟,但动捕演员依旧需要穿着笨重的动捕服进行演出,游戏开发方也需要购置昂贵的捕捉设备。倘若这项技术发展成熟,3D动捕的硬件门槛或还能进一步降低。在3D内容需求量逐渐扩张的如今,这项技术的到来无疑是福音。

高写实贴图:持续精益求精

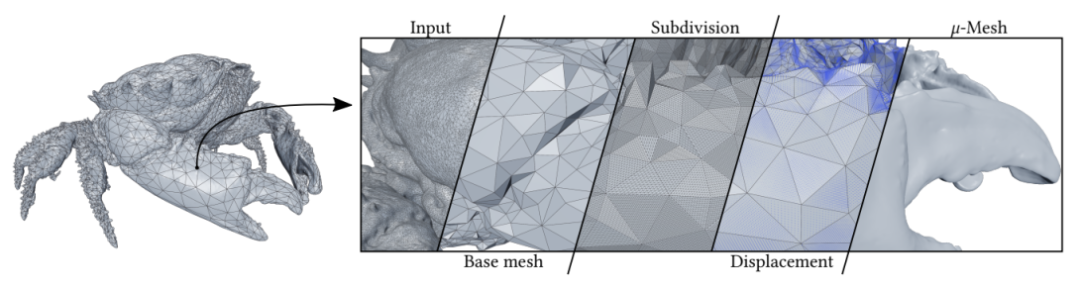

画质精细度的提升永远是游戏界津津乐道的话题。英伟达首先推出了一个名为-mesh的“微网格”系统,其实际效果与虚幻5引擎中的Nanite系统有些类似。英伟达表示,在不占用高显存的情况下,数百万多边形的精细模型可以被转换为-mesh进行处理,并支持光线追踪功能。

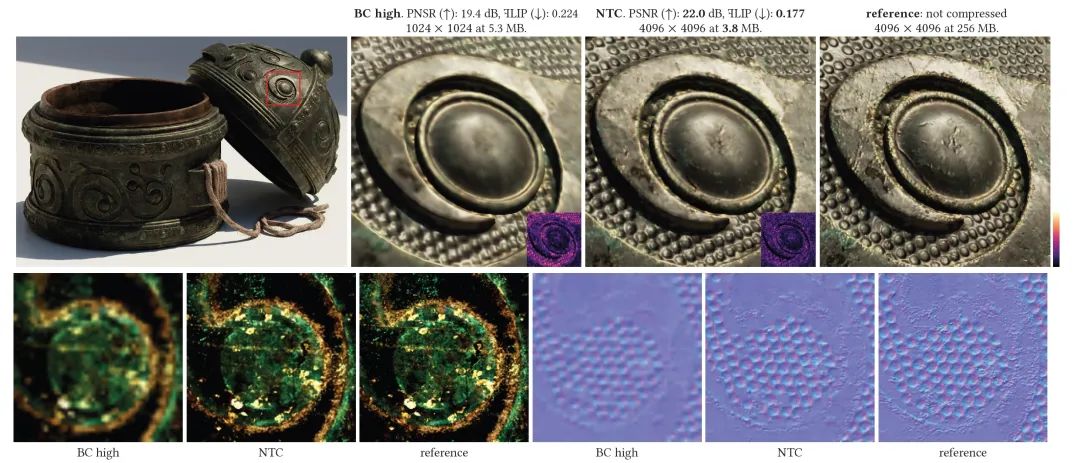

另一项纹理压缩算法的研究则有关高精度贴图进行压缩,在显存占用不变的情况下,这项技术允许贴图储存高达16倍的信息。在渲染写实度精益求精的当下,这无疑提升了贴图的创意空间。

结语

之所以能在计算机工业界屹立20余年,雄厚的科研实力就是英伟达的傍身法宝。而在GameLook眼中,除了科研实力外,英伟达在“抢热点”上表现出的不俗眼光也是其成功的原因。

从研究内容来看,英伟达的主要研究方向紧扣其主营业务的核心命脉。如AIGC、数字化身、动作捕捉等技术都是未来3D领域的重要生产能力。作为云服务和数据中心提供商,通过SaaS化,向B端厂商推出整合式解决方案,是英伟达的重要收入来源。尽管英伟达未必在每条赛道上都处于领先位置,但对全领域进行敏捷布局,正是英伟达长久立足的关键。而其技术优势也能形成滚雪球之势,也在不断的研发投入中逐渐拉大与其他厂家的身位。

····· End ·····

GameLook每日游戏产业报道

全球视野 / 深度有料

爆料 / 交流 / 合作:请加主编微信 igamelook

广告投放 : 请加 QQ:1772295880

长按下方图片,"识别二维码" 订阅微信公众号

····· 更多内容请访问 www.gamelook.com.cn ·····

Copyright © GameLook® 2009-2023

觉得好看,请点这里 ↓↓↓