关注“FightingCV”公众号

回复“AI”即可获得超100G人工智能的教程

“Transformer的挑战者”Mamba,用MacBook也能跑了!

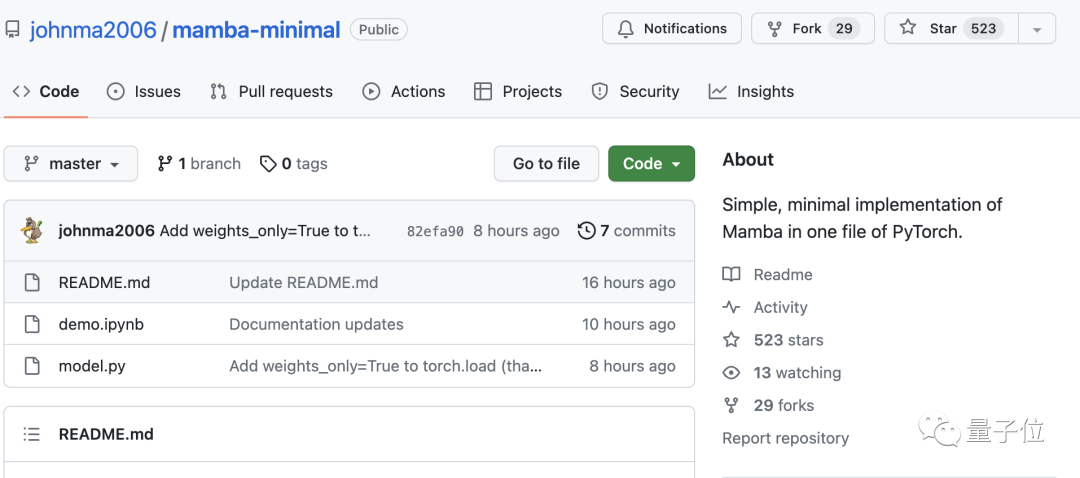

有大佬在GitHub上共享了一份笔记,让人们可以用最简单的方式运行Mamba。

这份共享中,算上说明书一共只有三个文件,而且发布不到一天,就斩获了500+星标。

Mamba是一种新的大模型架构,在语言任务上的表现可以与两倍规模的Transformer一决雌雄。

但官方给出的只有模型文件,需要一定专业知识才能部署使用,而且要Linux+N卡才能运行。

有了这份笔记,Mamba的运行步骤大大简化,而且也不再要求N卡,M系列的MacBook也能跑了。

从事相关专业的网友看了表示,这种简单化的模型实在是太棒了,希望自己的工作也能朝着这个方向进展。

原版Mamba的作者Tri Dao和Albert Gu也转发了这份笔记,并对它的简洁性和易读性给予了肯定。

那么,这份笔记该如何使用呢?

两个文件即可运行

首先,打开一个能运行PyTorch笔记的工具,比如Jupyter、VSCode,或者在线的谷歌Colab等。

然后下载作者的笔记和Python脚本,用Colab的话也可以使用GitHub导入功能。

如果在本地运行,需要把两个文件放到同一个目录;如果用Colab,则需要在连接成功后把model.py上传。

△如果不上传,会出现“找不到‘model’”的报错

之后是安装所需的依赖环境,Colab需要手动安装的是einops,其他工具可以根据报错信息判断缺少的依赖。

!pip install 需要安装的依赖名称

解决好依赖问题后,就可以点击笔记第一组中的运行按钮了,这里可以对模型规模进行选择,默认370M。

接下来是初始化,直接点击运行按钮即可。

这里也可以对输出token的数量进行调节,默认是50。

接着,笔记中给出了一些实例,我们也可以修改单引号之间的prompt内容(换行用\n表示),然后点击运行。

不过需要注意的是,这里的prompt和我们平时用ChatGPT等bot型应用的方式有所区别。

这里可以借用一下Hugging Face中Llama 2的系统提示词:

Below are a series of dialogues between various people and an AI assistant. The AI tries to be helpful, polite, honest, sophisticated, emotionally aware, and humble-but-knowledgeable. The assistant is happy to help with almost anything, and will do its best to understand exactly what is needed. It also tries to avoid giving false or misleading information, and it caveats when it isn’t entirely sure about the right answer. That said, the assistant is practical and really does its best, and doesn’t let caution get too much in the way of being useful.

User: 想问的问题

Assistant:

性能上,在默认的规模和输出长度(370M,50token)下,输入Once Upon a time,在纯CPU版Colab中需用时约1分钟,在TPU上的用时则约为30秒,内存消耗在3到4GB之间。

在M1芯片的Mac上,以相同设置处理同样的内容,则需花费1分半左右。

不过作者也解释道,出于易读性的考虑,去掉了原版Mamba中的一些加速指令。

参考链接:

https://news.ycombinator.com/item?id=38708730

量子位

往期回顾

基础知识

【CV知识点汇总与解析】|损失函数篇

【CV知识点汇总与解析】|激活函数篇

【CV知识点汇总与解析】| optimizer和学习率篇

【CV知识点汇总与解析】| 正则化篇

【CV知识点汇总与解析】| 参数初始化篇

【CV知识点汇总与解析】| 卷积和池化篇 (超多图警告)

【CV知识点汇总与解析】| 技术发展篇 (超详细!!!)

最新论文解析

NeurIPS2022 Spotlight | TANGO:一种基于光照分解实现逼真稳健的文本驱动3D风格化

ECCV2022 Oral | 微软提出UNICORN,统一文本生成与边框预测任务

NeurIPS 2022 | VideoMAE:南大&腾讯联合提出第一个视频版MAE框架,遮盖率达到90%

NeurIPS 2022 | 清华大学提出OrdinalCLIP,基于序数提示学习的语言引导有序回归

SlowFast Network:用于计算机视觉视频理解的双模CNN

WACV2022 | 一张图片只值五句话吗?UAB提出图像-文本匹配语义的新视角!

CVPR2022 | Attention机制是为了找最相关的item?中科大团队反其道而行之!

ECCV2022 Oral | SeqTR:一个简单而通用的 Visual Grounding网络

如何训练用于图像检索的Vision Transformer?Facebook研究员解决了这个问题!

ICLR22 Workshop | 用两个模型解决一个任务,意大利学者提出维基百科上的高效检索模型

See Finer, See More!腾讯&上交提出IVT,越看越精细,进行精细全面的跨模态对比!

MM2022|兼具低级和高级表征,百度提出利用显式高级语义增强视频文本检索

MM2022 | 用StyleGAN进行数据增强,真的太好用了

MM2022 | 在特征空间中的多模态数据增强方法

ECCV2022|港中文MM Lab证明Frozen的CLIP 模型是高效视频学习者

ECCV2022|只能11%的参数就能优于Swin,微软提出快速预训练蒸馏方法TinyViT

CVPR2022|比VinVL快一万倍!人大提出交互协同的双流视觉语言预训练模型COTS,又快又好!

CVPR2022 Oral|通过多尺度token聚合分流自注意力,代码已开源

CVPR Oral | 谷歌&斯坦福(李飞飞组)提出TIRG,用组合的文本和图像来进行图像检索