公众号关注 “ML_NLP”

设为 “星标”,重磅干货,第一时间送达!

转载自 | 专知

【导读】ACM SIGKDD(国际数据挖掘与知识发现大会,简称 KDD)是世界数据挖掘领域的最高级别的学术会议,由 ACM 的数据挖掘及知识发现专委会(SIGKDD)主办,被中国计算机协会推荐为 A 类会议。自 1995 年以来,KDD 已经连续举办了26届,今年将于2021年8月14日至18日举办,今年的会议主办地在新加坡。

来自Brandeis大学等的图机器学习领域研究人员在KDD2021上将给出关于图机器学习:进展,方法、应用与系统的教程,非常值得关注!

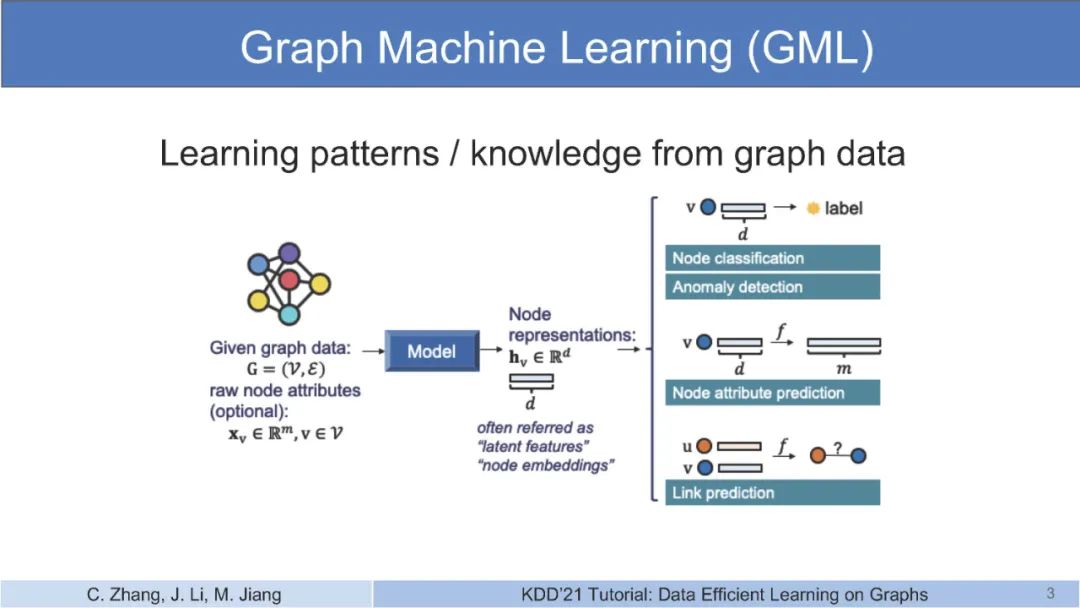

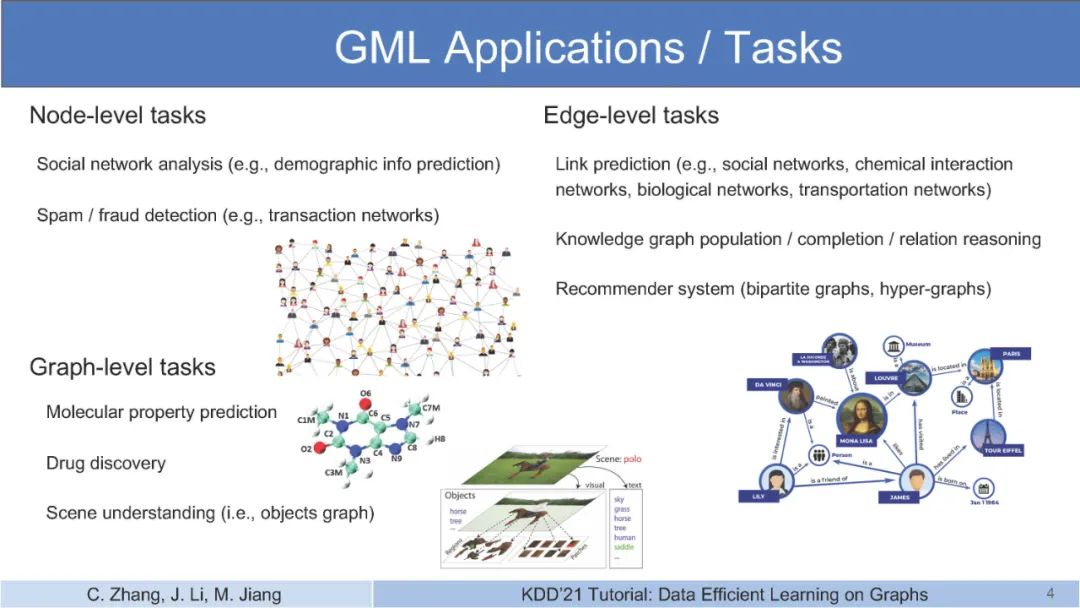

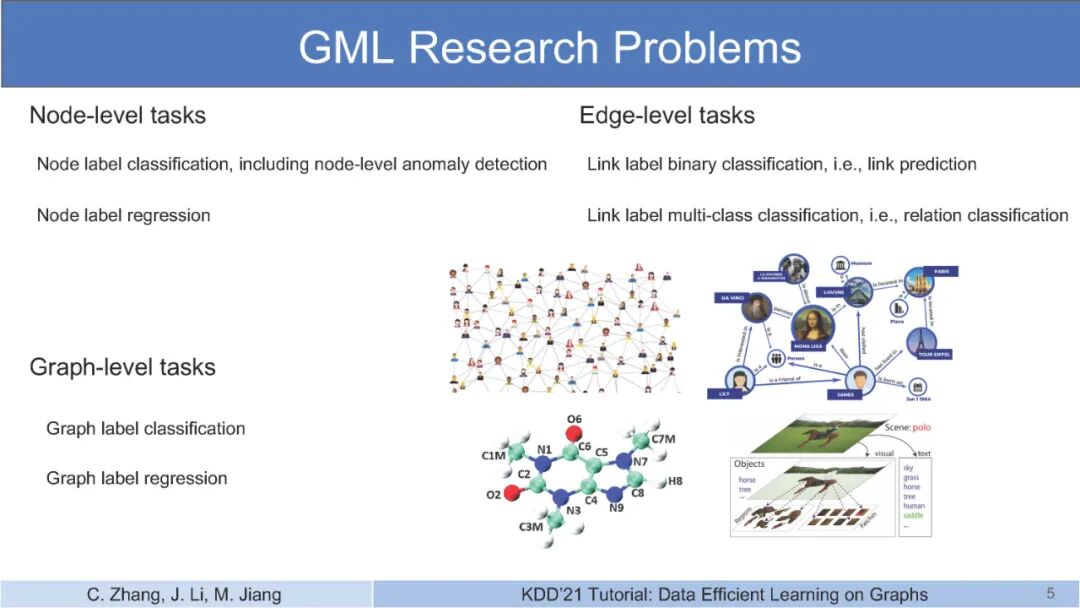

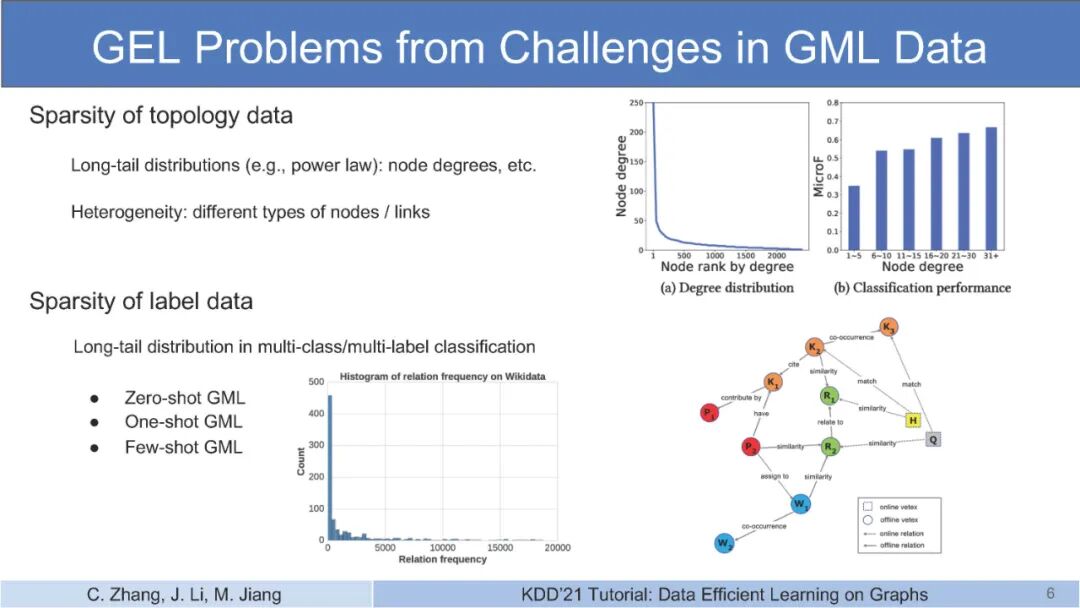

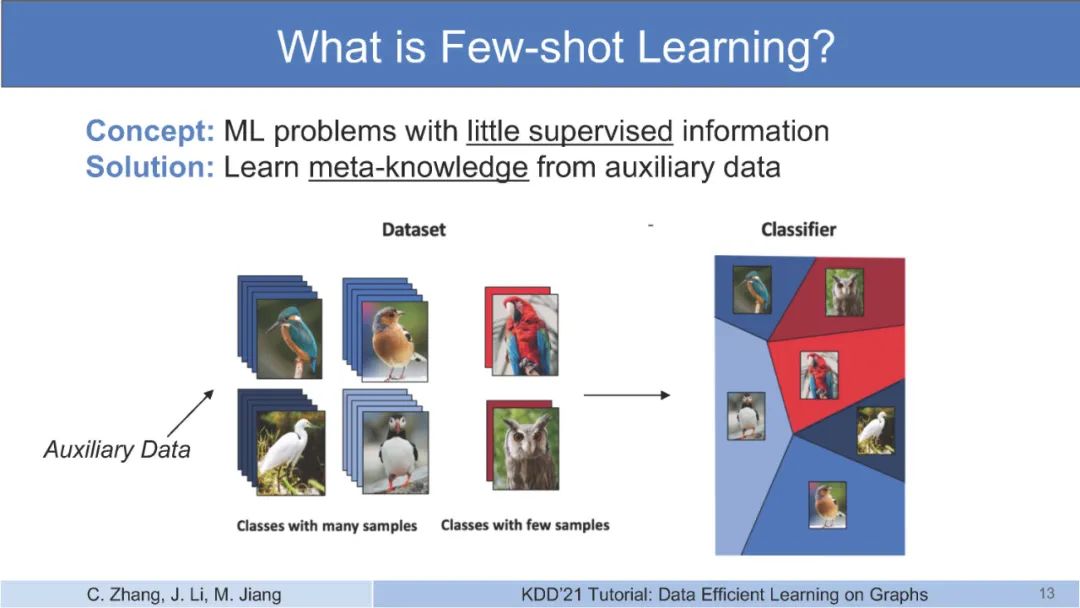

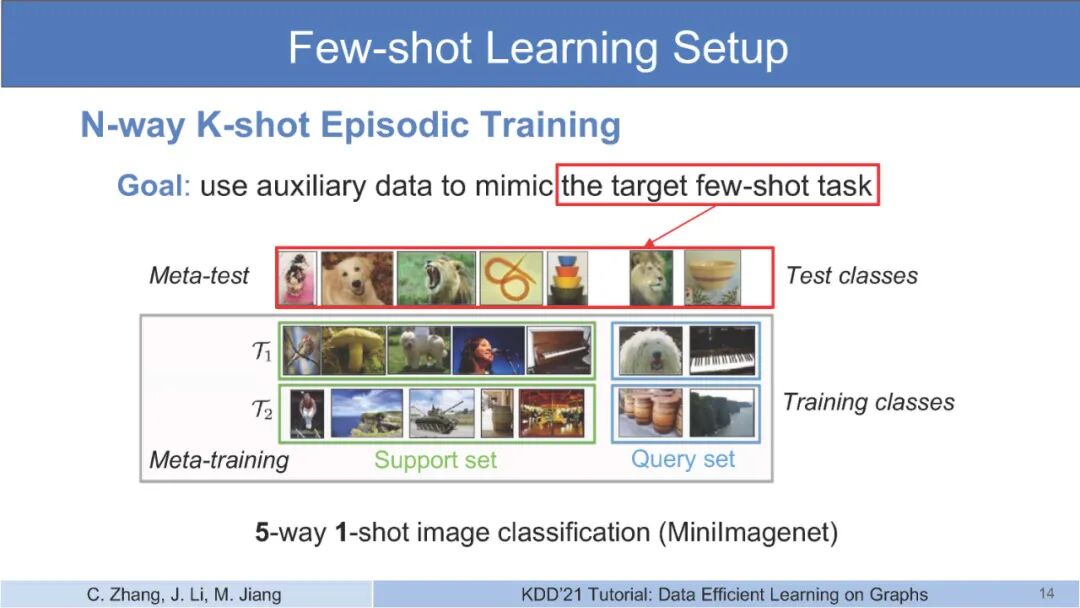

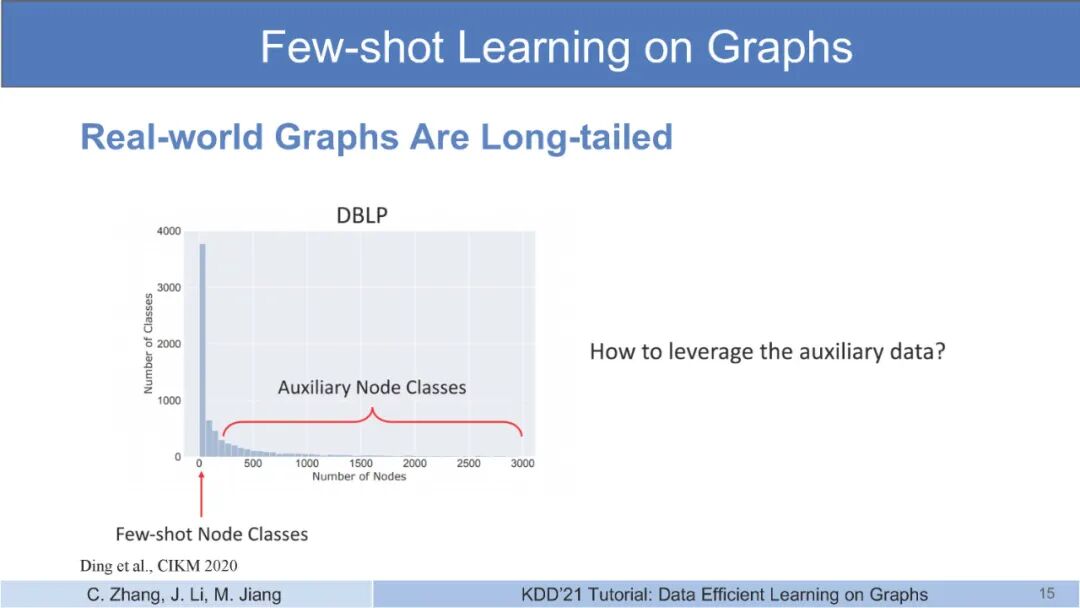

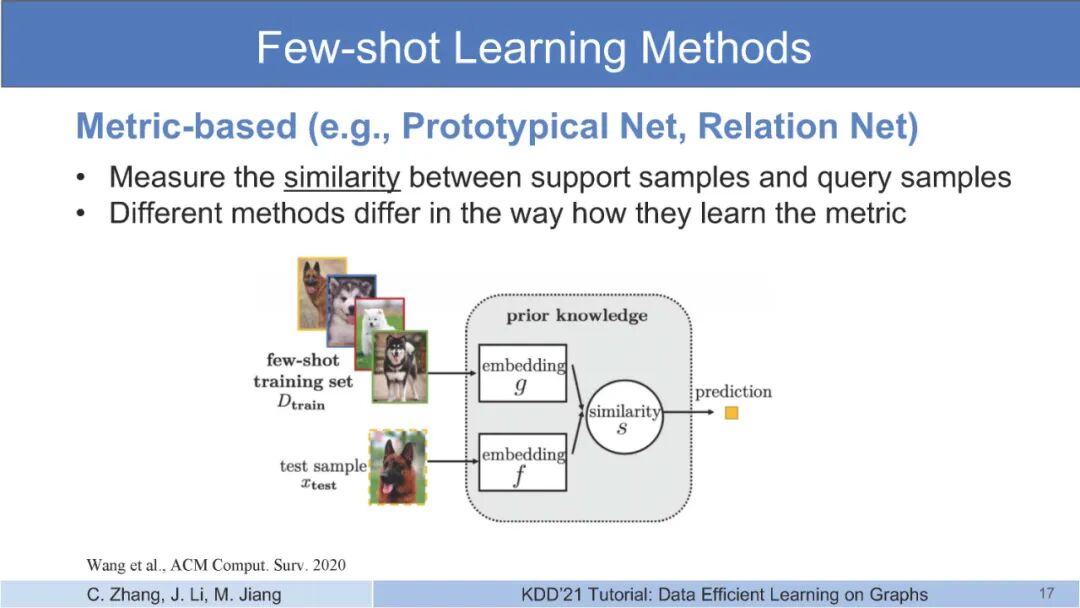

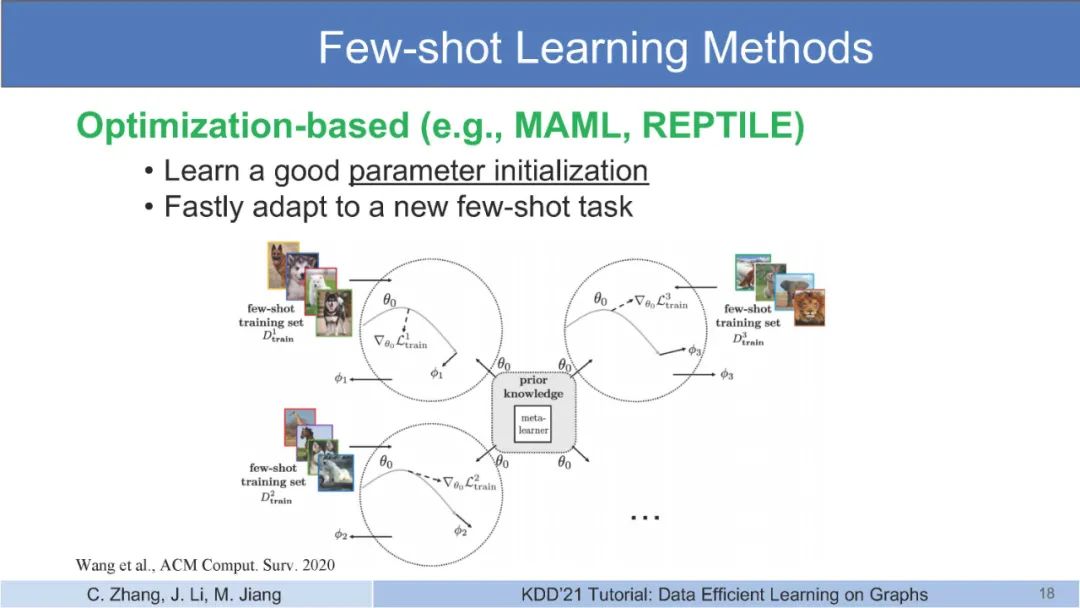

目前流行的图表示学习(GRL)方法通常依赖于从“大”数据中学习,需要大量标注数据进行模型训练。然而,通常情况下,图形与“小”标记数据相关联,因为数据注释和标记总是一项耗时和资源消耗的任务。这个事实掩盖了GRL在许多实际情况下的能力和适用性。因此,对图的数据有效学习已经成为许多现实应用的必要条件,近年来已经有许多关于这一主题的研究。在本教程中,我们将系统地回顾近年来关于图数据高效学习的研究,特别是图少样本学习和图自监督学习的一系列方法和应用。首先,我们将介绍图表示学习方法、传统的少样本学习和自监督学习技术的概况。然后,我们将从三个主要的不同粒度的图挖掘任务: 节点级学习任务、图级学习任务和边缘级学习任务来介绍图数据高效学习的工作。最后,我们将总结本教程,并提出未来研究中有待解决的问题和迫切需要解决的问题。本教程的作者是这个研究领域的活跃和多产的研究者。关键词: 图表示学习,数据高效学习,少样本学习,自监督学习

https://kdd2021graph.github.io/

现实世界的系统通常被建模为图形,表示由边(关系)连接的节点(实体)以及节点和边中的内容。在进行特定目的的机器学习算法特征工程时,系统中的大规模数据收集既需要领域理解,又需要较大的探索搜索空间。因此,许多数据驱动图表示学习技术(data-driven graph representation learning techniques, GRL)[6,21]被提出用于自动生成各种应用领域的图的特征表示,包括信息服务、医疗保健、网络安全等。

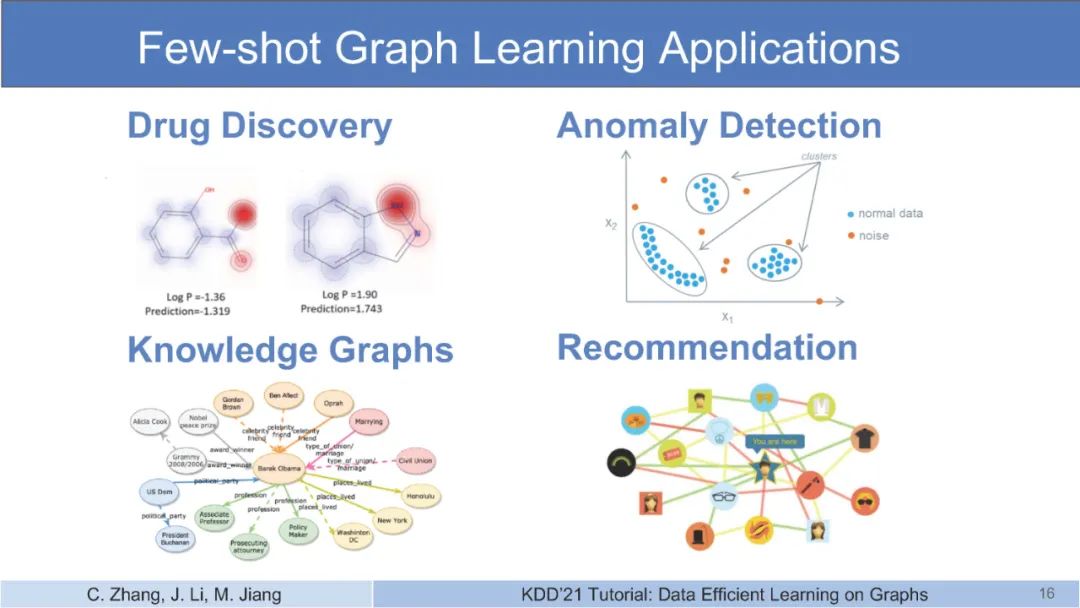

在一个系统中开发强大的GRL通常需要大量的特定任务的监控信息(标记数据)进行模型训练。然而,丢失或缺少标签数据在实际系统中是很常见的,做数据注释通常代价很高。例如,治疗活性的分子特性检测需要大量的人力物力和实验资源。对于进入系统的新用户/实体,信息服务面临冷启动问题。近年来,研究者针对GRL中的小标记数据挑战提出了许多数据高效学习模型,主要基于少样本学习[19]和自监督学习[11]。因此,我们有动机组织本教程来回顾最近关于图表数据高效学习的工作,并讨论它们如何解决现实世界的问题。结合不同粒度级别的主要图数据挖掘任务,本教程将研究内容分为概览、节点级数据高效学习、图级数据高效学习和边缘级数据高效学习四个部分。

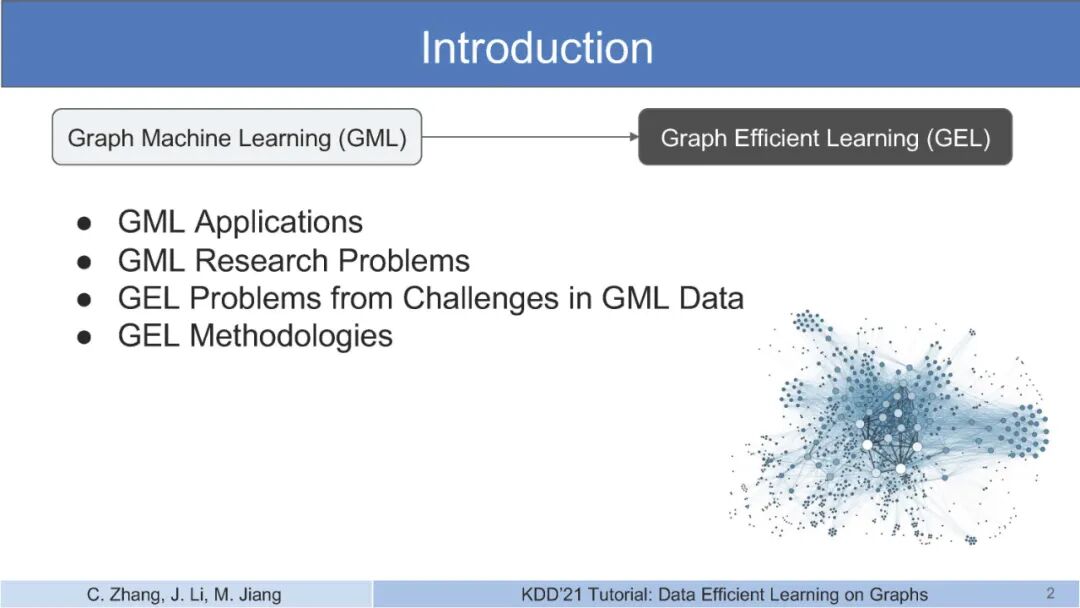

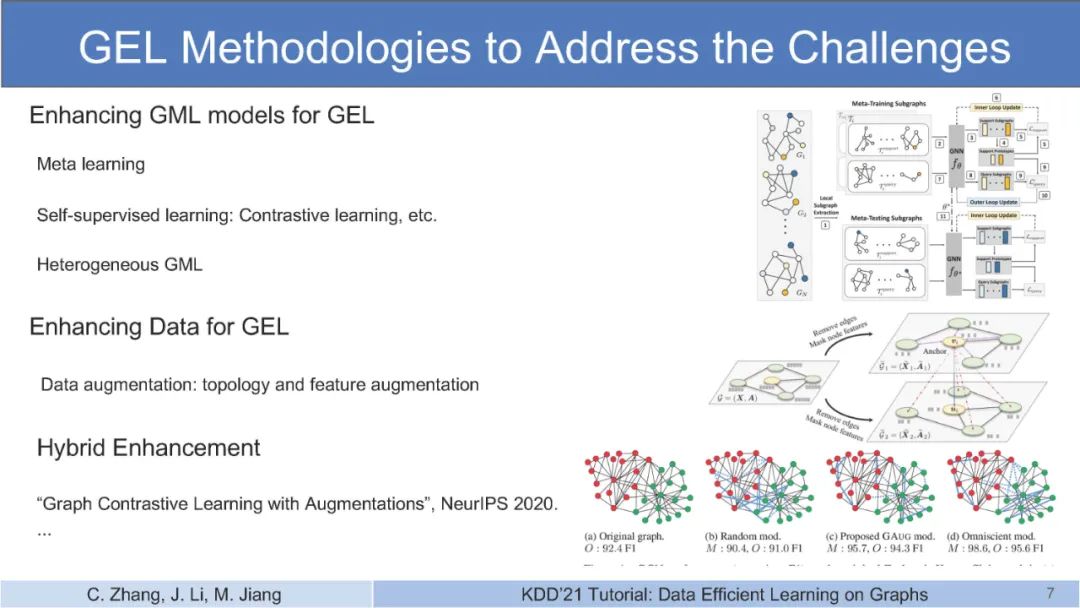

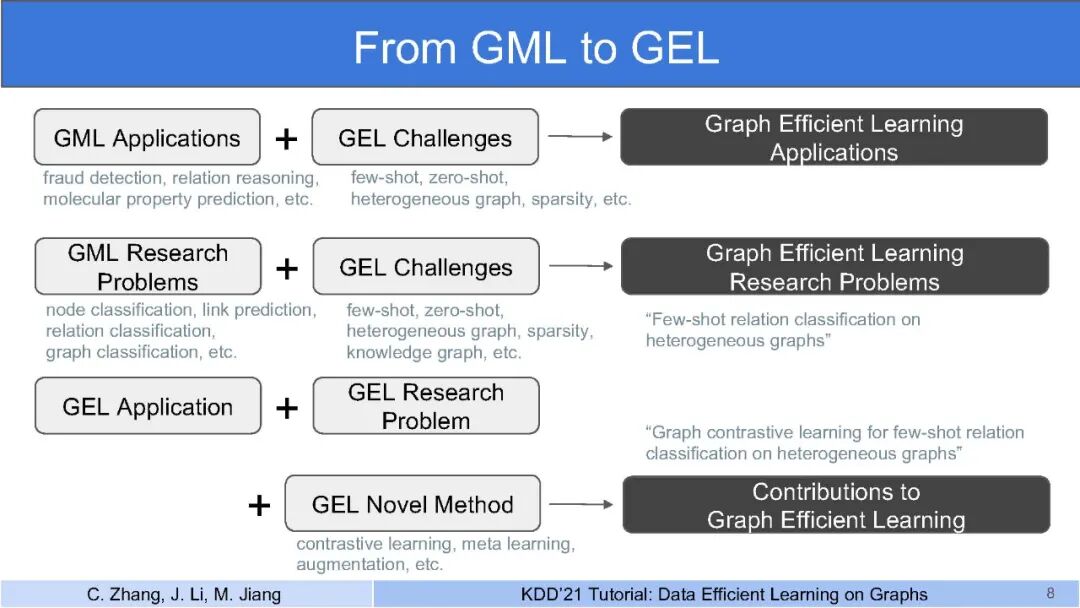

概述。我们将介绍背景和概述。首先,我们将介绍主要的图表示学习方法[6,21],传统的少样本学习[19]和自监督学习技术[11]。然后,我们将介绍数据高效GRL研究的概况。

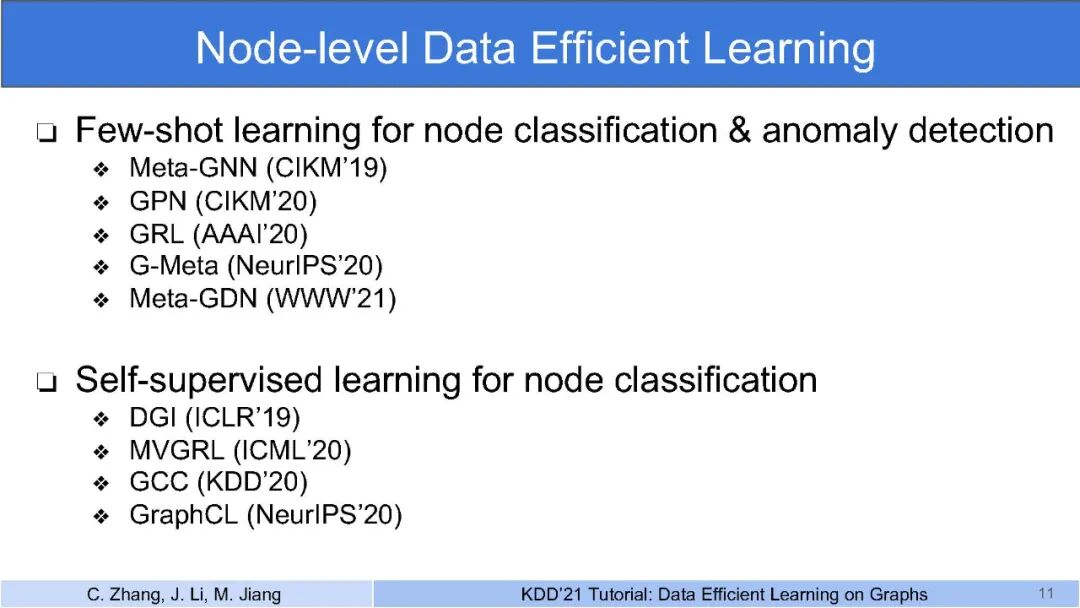

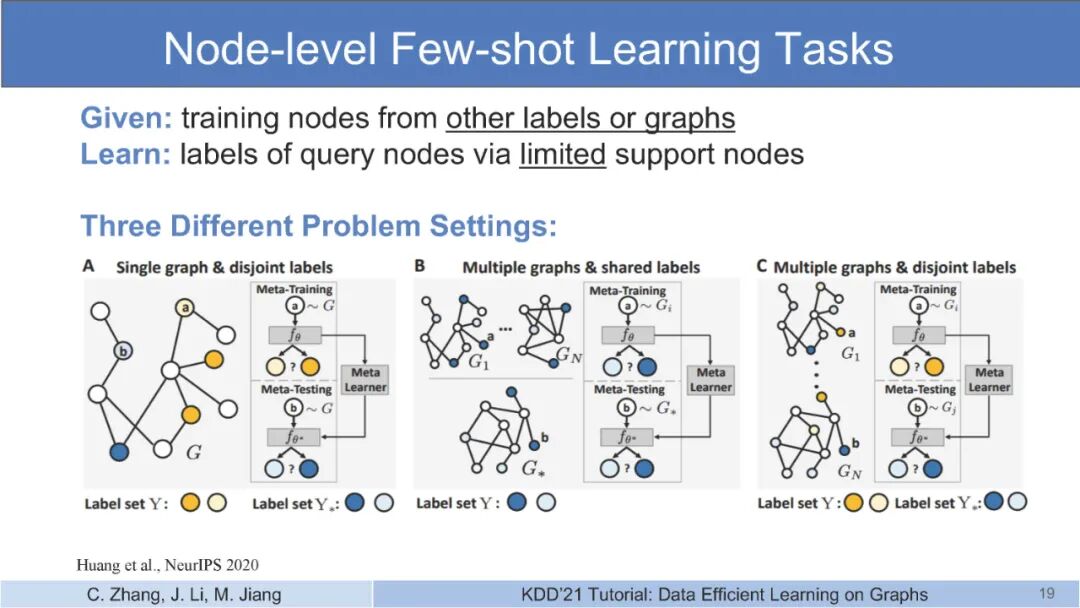

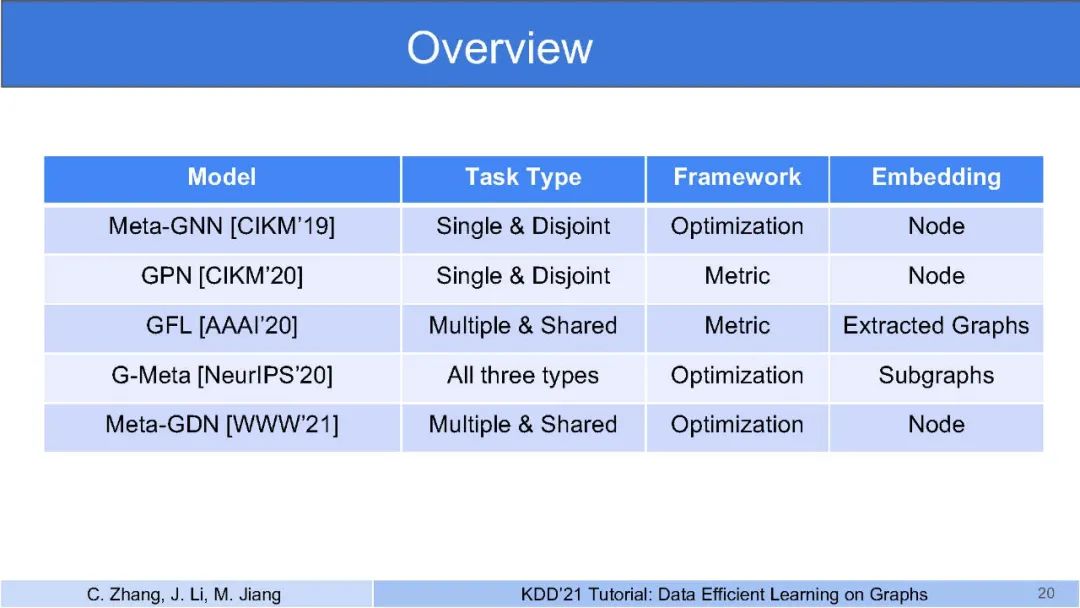

节点级数据高效学习。我们将在节点级别上介绍数据高效学习的方法和应用。目标是用小的标记数据对图上的节点进行预测。我们将涵盖一般节点分类[2,7,8,10,16,18,23,24,28]和异常检测[3,12,15]。

图级数据高效学习。我们将介绍数据高效学习的方法和应用。与节点级预测任务不同,目标是使用少量注释信息对整个图进行预测。我们将讨论一般的图分类[1,14]和分子预测[5,17]。

边级数据高效学习。我们将在边级层面讨论数据高效学习的方法和应用。其目的是利用小的已知关系数据对关系结构进行建模,并预测节点之间的缺失关系。我们将包括链路预测[4,9,22,26]、多跳关系推理[13,27]和推荐[20,25]。

目录:

Part 1: Background and Overview

Part 2: Node-level Data Efficient Learning

Part 3: Graph-level Data Efficient Learning

Part 4: Edge-level Data Efficient Learning

Part 5: Conclusions and Discussions

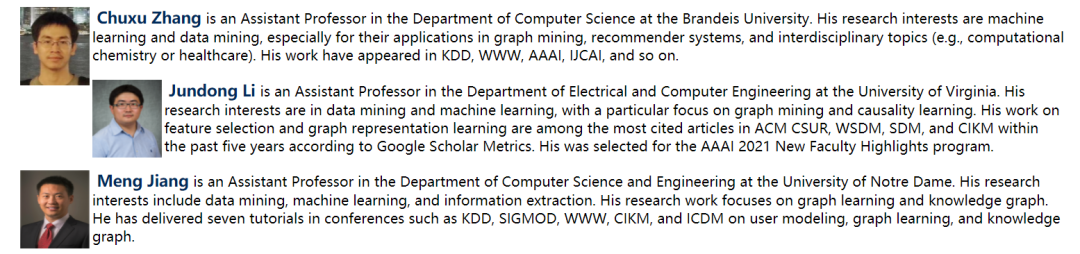

讲者

参考文献

[1] Jatin Chauhan, Deepak Nathani, and Manohar Kaul. 2020. Few-Shot Learning on Graphs via Super-Classes based on Graph Spectral Measures. In ICLR.

[2] Kaize Ding, Jianling Wang, Jundong Li, Kai Shu, Chenghao Liu, and Huan Liu. 2020. Graph Prototypical Networks for Few-shot Learning on Attributed Networks. In CIKM.

[3] Kaize Ding, Qinghai Zhou, Hanghang Tong, and Huan Liu. 2021. Few-shot Network Anomaly Detection via Cross-network Meta-learning. In WWW.

[4] Tianyu Gao, Xu Han, Ruobing Xie, Zhiyuan Liu, Fen Lin, Leyu Lin, and Maosong Sun. 2020. Neural Snowball for Few-Shot Relation Learning. In AAAI

点击下方卡片,关注公众号“机器学习算法与自然语言处理”,获取更多信息: