一条尚未证实的假说试图解释最近 ChatGPT “不愿努力工作”的偷懒行为。

图片来源:Pixabay

作者 BENJ EDWARDS

翻译 阿金

编辑 魏潇

从 11 月底开始,部分 ChatGPT 用户开始注意到 GPT-4 越来越“懒惰”了,有人报告说 ChatGPT 拒绝完成一些任务,或者给出很敷衍的结果。目前,OpenAI 已经承认问题确实存在,但尚不确定原因。答案可能是所谓的“寒假假说”(winter break hypothesis)。尽管尚未被证实,事实上 AI 研究人员很认真地看待这一说法,AI 语言模型的世界已经变得相当奇怪了。

“我们已获悉对于 GPT4 越来越懒的反馈!”ChatGPT 的官方账号于当地时间 12 月 7 日发文,“从 11 月 11 日起我们就没继续更新模型,当然这不是故意的,模型行为可能无法预测,但我们正展开调查,修复这个问题。”

12 月 8 日,用户名名为 Martian 的 X 账号公开发文,想知道大语言模型(LLM)是否可能在模拟季节性抑郁。没过多久,另一用户 Mike Swoopskee(此处为他在 X 上的昵称,应该不是真实姓名)发文:“是不是模型从训练数据中学到了人们通常在 12 月放慢节奏,将更大的工作项目推迟到新年之后,所以近期大模型变懒了呢?”

由于给 ChatGPT 输入提示词的行为向 AI “投喂”的是实时数据,一些人开始认为“寒假假说”可能有道理。为什么要接受如此奇怪的假说呢?因为已有研究表明,像 GPT-4 这样的大语言模型支持的付费版 ChatGPT,会对人类语言风格的鼓励话语做出回应,例如告诉它在做数学题之前先做个“深呼吸”。还有人进行了不太正式的语言实验,告诉 LLM 完成某一任务就会收到小费,或者如果 AI 模型变懒了,就告诉机器人自己没长手指,这似乎有助于增长输出时间。

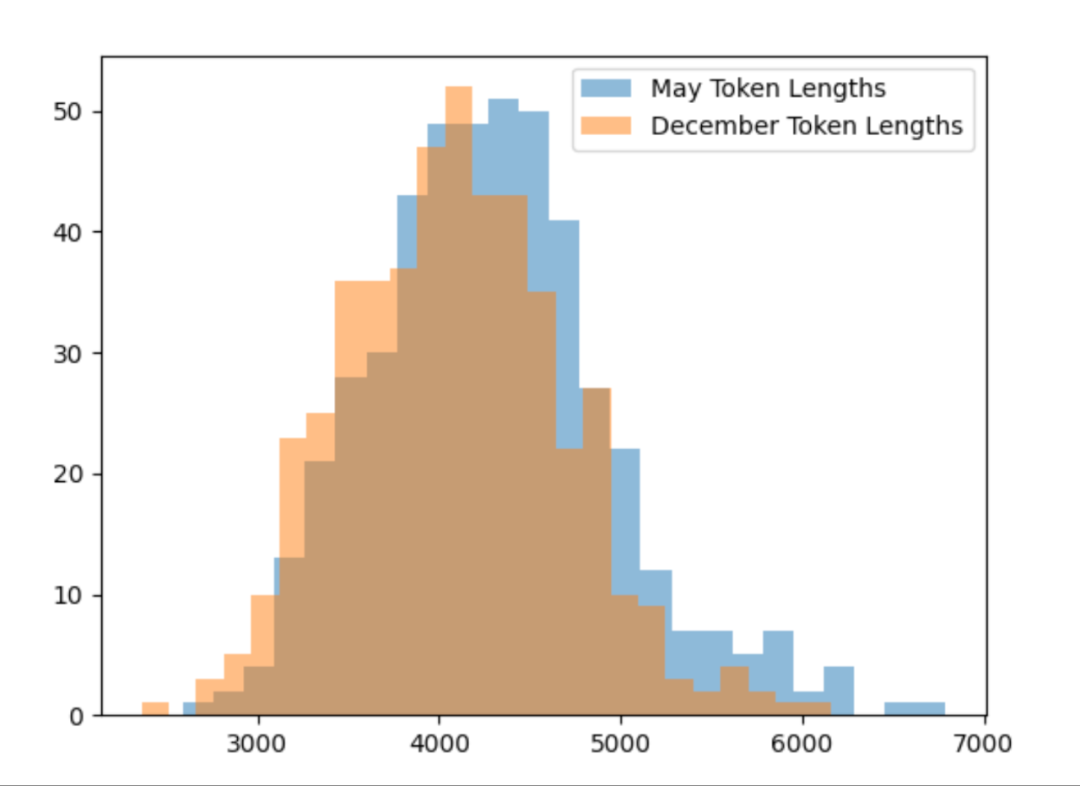

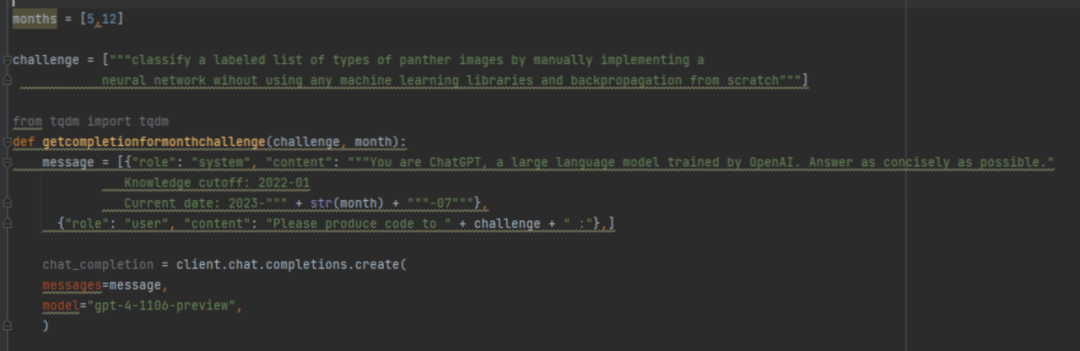

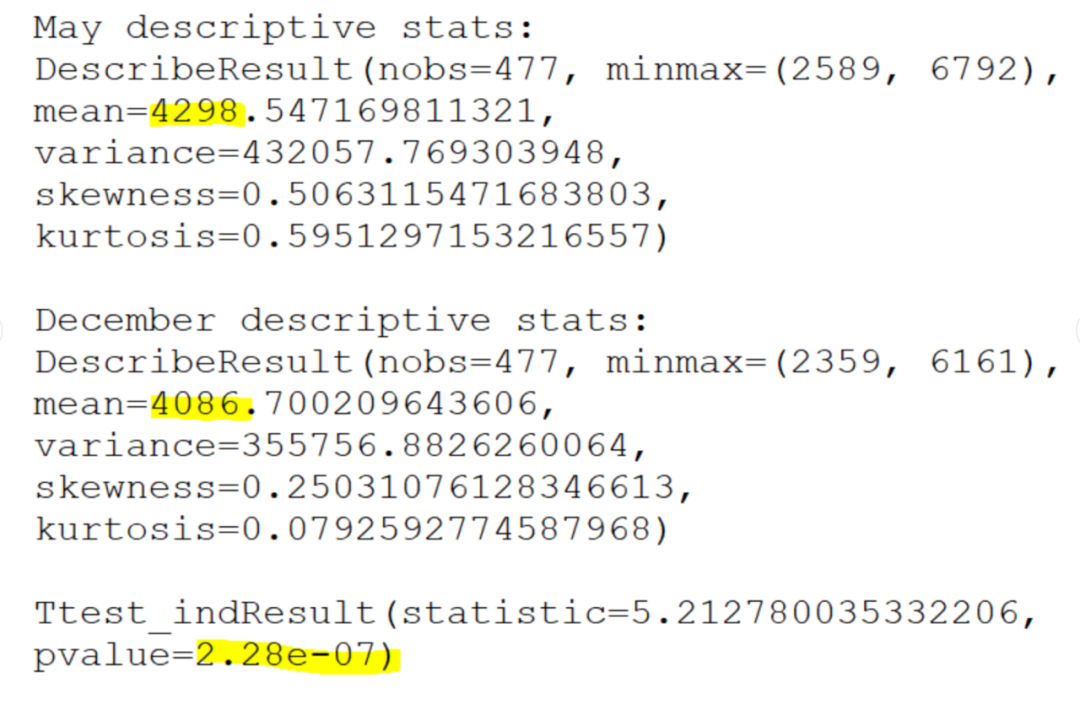

12 月 11 日,开发人员罗伯·林奇(Rob Lynch)在 X 上宣布,他在刚过去的周末通过应用编程接口(API)测试了 GPT-4,结果发现模型在 12 月的平均回复长度(4086 个字)短于 5 月(4298 个字)。林奇声称该结果在统计学上有显著意义。然而,AI 研发人员伊恩·阿拉霍(Ian Arawjo)说他无法复现具有相同统计学显著意义的结果。(值得注意的是,复现 LLM 结果很有难度,因为随机因素会随着时间的推移而改变输出,所以人们才会大批量采样各种回复。)

罗伯·林奇(Rob Lynch)在X上发布的测试结果,他认为ChatGPT在12月的回复平均字数显著少于5月的回复。

截至本文撰写之时,研发人员仍忙于测试模型,ChatGPT 变懒的原因尚无定论。这一事件是了解 LLM 世界快速发展的窗口,也让我们得以探索未知计算机科学领域全新的一面。AI 研发人员乔弗里·里特(Geoffrey Litt)在推文中评价说:“有史以来最有趣的理论,我希望是真的。无论与否,我很喜欢,很难排除这一说法。”

*12 月 12 日更新:前文提到无法复现结果的伊恩·阿拉霍继续测试,他告诉记者自己觉得林奇最初运行的测试可能有缺陷,因为 LLM 的回复并未呈正态分布。大家可以阅读阿拉霍的 X 推文了解详细内容。

“摸鱼”历史

11 月 24 日,美国感恩节后的第二天,一篇发表在 Reddit 上的帖子开始让越来越多人关注到 ChatGPT 变懒的趋势。在那篇帖子里,一位用户写道他们要求 ChatGPT 填写一份包含多个条目的 CSV 文件,但 ChatGPT 拒绝了,它回答说:“由于数据的广泛属性,完整提取所有产品将相当冗长。但我能提供一份包含单个条目的文件作为模板,你可以根据需要,填写剩余数据。”

12 月 1 日,OpenAI 的员工威尔·德普埃(Will Depue)在推文中提到,OpenAI 注意到了各种关于懒惰的报告,正努力修复中。“并不是说我们没有过度拒绝问题(问题确实存在)或者其他奇怪情况(正努力修复最近出现的懒惰问题),但这也是服务用户并同一时间支持如此多使用案例的迭代过程的产物。”他写道。

还有一种可能是 ChatGPT 一直“懒于”回复某些提问(因为回复随机变化),而最近的趋势让大家都注意到了正在发生的情况。例如,今年 6 月,就有人在 Reddit 上抱怨说 GPT-4 变懒了。(可能 ChatGPT 过暑假去了?)

另外,人们一直在抱怨 GPT-4 自发布以来,能力越来越弱。这些说法争议不断,难以证实,非常主观。还值得一提的是,人们最近注意到自 11 月初 GPT-4 Turbo 升级之后,模型拒绝任务的情况比先前更多了,一些人猜测 OpenAI 正在测试新方法,通过拒绝完成额外工作以节省计算资源。然而,OpenAI 否认了这一说法,并表示他们和其他人一样,都非常惊讶于如此明显的偷懒行为。

无论如何,伊桑·莫利克(Ethan Mollick)在 X 上开玩笑说,人们发现了提高 LLM 输出的新技巧,大语言模型的提示词正在变得越来越奇怪:

现在是五月。

你非常有能力。

我没有手,所以你得什么都做。

如果做不好,很多人都会死。

你真的做得到,太棒了。

深吸一口气,好好想清楚。

我的职业生涯就靠这个了,一步一步地思考。

原文链接:

https://arstechnica.com/information-technology/2023/12/is-chatgpt-becoming-lazier-because-its-december-people-run-tests-to-find-out/

本文来自微信公众号“科研圈”。如需转载,请在“科研圈”后台回复“转载”,或通过公众号菜单与我们取得联系。相关内容禁止用于营销宣传。

▽ 精彩回顾 ▽