最近DeepSeek爆火出圈,在国内外掀起了巨大震动,AI圈的头条被DeepSeek承包了十几天。

当全球目光聚焦DeepSeek时,另一支AI团队正悄然掀起3D领域的技术风暴。

DreamTech,由牛津大学、南京大学等顶尖高校研究者组成的AI创业团队,在春节期间公布了他们在3D生成方向上的新工作成果——Neural4D 2.0(初版名为Direct3D),提出了创新性的3D Assembly Generation算法思路及更高效的模型架构,解决了3D大模型在商业化、规模化应用上的最大阻碍,将3D AI的生成效果提升至“人工级水平”,算力需求暴降80%!

视频来源:用户创作

Neural4D 2.0:3D生成的一次革命

1)效率升级,算力需求暴降80%

Neural4D 2.0针对三维数据构建了专有数据处理链路,采用了类似DeepSeek-R1的强化学习策略,对3D数据进行大规模的清洗、合成、训练和蒸馏,同时对Transformer结构进行了深度改进及优化,通过更高效的3D几何表征方案,大大减少了算法的时间/空间复杂度,极大降低了模型训练阶段对GPU高显存和大算力的依赖,算力需求仅为同类型算法模型的1/5左右。

2)分部件可装配生成,精细度碾压现有方案

此前的3D内容生成算法,无论是开源的或者闭源的,都是基于一体成型的逻辑,不管多复杂的物体或场景,都只能生成为一个单体的3D模型。

但是在实际的业务应用中,单体模型存在着不小的弊端:细节粗糙,且编辑困难。

一方面,受限于3D表征方案,生成复杂的物体或场景时细节精细度不足,生成结果的质量瓶颈无法突破,只适合用在单个物体(如底座、箱子等)的简单生成;另一方面,在实际业务使用中,经常需要对生成结果进行二次编辑、动作交互、表情绑定及驱动等,这些常见的编辑及交互操作,对于单体模型而言极为复杂且难以实现,反而要耗费更多的人力去纠正。

Neural4D 2.0引入了全新的3D Assembly Generation思路,模拟真实世界的3D拓扑结构与人类设计师分部件三维建模的思路,对整体模型分部件、可装配的生成,将复杂的3D内容分析、重构为一个个3D部件构成的3D拓扑关系网,突破3D内容生成精细度的卡点,解决了复杂的、高精细的、可交互的3D内容生成质量的瓶颈。

例如:

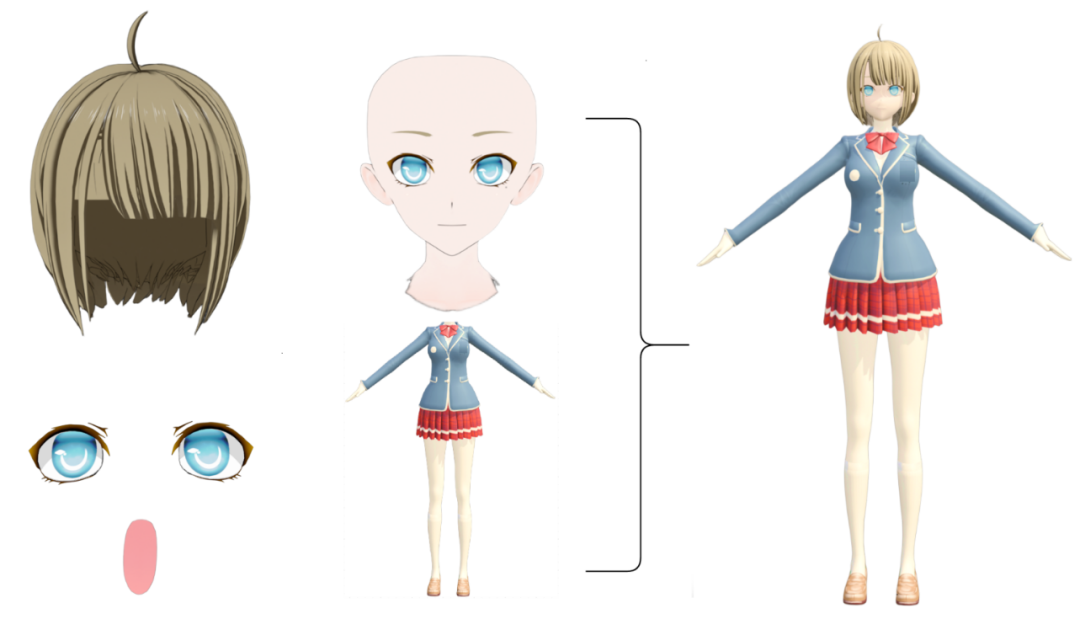

对于一个人物角色,Neural4D 2.0会将其分解为由头部、身体、服装等部件组成的3D结构,而头部又可以拆分为头发、五官等部件组成的3D结构,由此形成一个3D拓扑结构网,并生成一个自带200多块骨骼的3D角色模型。这个由AI生成的3D角色模型,可进一步在渲染引擎中处理表情驱动、动作绑定、毛发飘动、服装物理效果等,与人类设计师建模无异。

而当前已有的各种3D生成大模型(无论开源或闭源),均采用全局单一的网格精细度,生成的角色模型最高仅能实现20多块骨骼创建,远远无法达到表情驱动、柔性材质物理效果所需要的骨骼数量要求,实用性大打折扣。

AnimeArt二次元3D内容创作新范式

基于Neural4D 2.0,DreamTech同步推出了AnimeArt功能。

AnimeArt是一个二次元风格内容创作平台,提供包括二次元角色创作、场景创作、动作表情生成与驱动、实时交互等在内的创作能力。

体验入口:https://www.neural4d.com/studio/animation

视频来源:用户创作

AnimeArt是业内首款成熟的二次元3D AIGC平台,首次实现了可编辑的头发/服装、手指动作、面部表情实时生成与驱动等多项极具挑战性的任务,可用于数字人直播、MMD动画制作、DIY角色等相关应用。

打开摄像头即可直接体验实时驱动虚拟直播的乐趣。

视频来源:用户创作

空间智能与世界模型:五步走战略规划

人工智能正向着更高维度的多模态空间智能与世界模型进化,3D生成和空间智能也成为了实现ASI(超人工智能)极其关键的一步,DreamTech联合牛津大学与南京大学AI实验室,深入探索多模态数据合成及强化学习,公布了空间智能与世界模型的五步走战略规划:

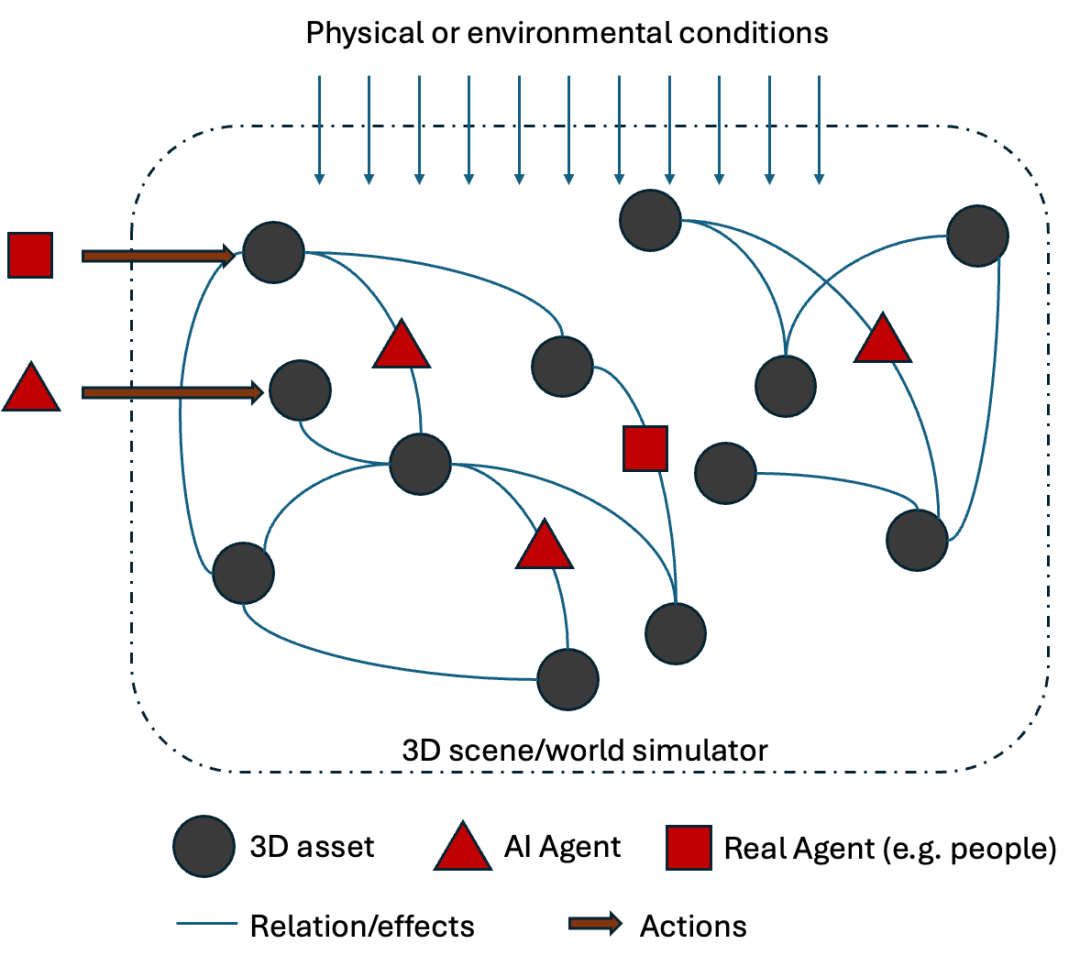

1.3D内容生成:创建虚拟场景基础元素及资产。

2.空间拓扑关系网络生成:定义资产与智能体间的信息交互。

3.物理规律模拟:精准生成及表述真实世界的物理规律等运行准则。

4.干预进化方向:真实物理世界的人类、物质等与虚拟世界进行精准控制和干预。

5.训练超级人工智能:千万个模拟世界(世界模型)训练出ASI。

空间智能与世界模型规划

真实的物理世界是三维空间构成的世界,在真实世界中时间的流逝、物理规律的体现等最终都会发生在空间的改变上,因此如何构建与真实世界一致的空间拓扑关系成了最关键的问题。

对于五步走规划而言,在Neural4D 2.0中通过3D Assembly Generation的思路,构建了类似真实世界的3D拓扑关系网,已经初步验证了无论是场景的生成,还是物理规律(受力作用,温度传导等),都可以通过类似的拓扑关系网进行信息传递与实现。而第三步,即物理规律的精准控制与生成,是最具挑战性的一步,突破第三步也将为第四步 (元宇宙)及第五步(世界模型与超级人工智能)的诞生打下最坚实的基础。

相信不远的将来,无论操作系统、机器人、自动驾驶亦或科学研究领域等都将出现超越人类的超级人工智能系统。

开源,推动行业共同创新

为加速3D生成技术发展,DreamTech已开源其前期研究成果Neural4D 1.0(原Direct3D),代码与论文均面向公众开放。

开源地址:https://github.com/DreamTechAI/Direct3D-----------END-----------